Ретробенчмаркинг — GeForce 8800 GT (G92)

Введение

К последнему кварталу 2007 года, несмотря на наличие в продаже топовых и предтоповых DirectX 10 ускорителей от обоих конкурентов, ситуация на рынке видеокарт была отнюдь не из приятных для массового покупателя. Дело в том, что наиболее востребованные решения среднего и начального уровня и от NVIDIA, и от AMD были слишком сильно урезаны по количеству исполнительных блоков и шине памяти и фактически были неспособны выдавать хоть сколь-нибудь приемлемую производительность в актуальных играх. Огромная ниша между $200 и $400, приносившая в те годы основной доход, на рынке DirectX 10 ускорителей фактически пустовала. У NVIDIA имелась, конечно, версия GeForce 8800 GTS за $300 с урезанным до 320 МБ объёмом видеопамяти, но столь малого объёма памяти оказалось недостаточно для раскрытия потенциала, заложенного в столь мощный чип. AMD же располагала ускорителем Radeon HD 2900 PRO, представлявшим собой почти точную копию Radeon HD 2900 XT с несколько заниженными тактовыми частотами и ценой аж на $150 ниже таковой у Radeon HD 2900 XT ($249 против $399), однако, жизнь HD 2900 PRO была уготована очень короткая, ибо RV670 уже был "на подходе", и, как следствие, доступность карты была невелика.

Безусловно, оба производителя видеоускорителей прекрасно понимали, что крайне желательно ещё до начала рождественских каникул представить достаточно мощные для актуальных игровых проектов решения среднего уровня, чтобы под рождество собрать как можно больше "сливок" с уже уставших ждать адекватных массовых DirectX 10 ускорителей "ждунов". И первой такой продукт представила NVIDIA. Новая видеокарта, получившая название GeForce 8800 GT, была основана на новом же чипе G92 и, наконец, принесла с собой в средний ценовой сегмент и сравнительно большое количество исполнительных блоков, и сравнительно широкую 256-битную шину памяти.

реклама

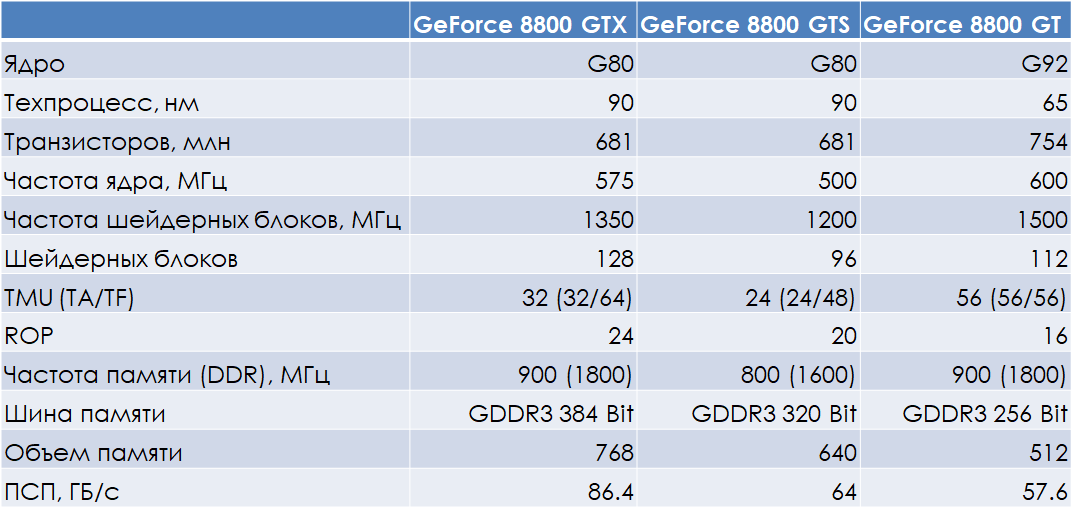

Новый чип G92 представлял собой немного урезанный флагманский чип G80, переведенный на 65-нм техпроцесс с незначительными архитектурными изменениями. По всей видимости, именно переход на более тонкий техпроцесс позволил NVIDIA снизить себестоимость производства и представить столь мощное решение в среднем ценовом сегменте. Чип имел в своём составе 7 кластеров TPC и, соответственно, 112 потоковых процессоров SP и 56 текстурных блоков TMU, что помещало его аккурат между GeForce 8800 GTS и GeForce 8800 GTX с 6 и 8 кластерами TPC, соответственно. При этом потоковые процессоры остались практически без изменений, а вот текстурные модули в G92 несколько отличались от таковых в G80 — в G92 каждый TMU имел 8 модулей адресации текстур TA и 8 же модулей фильтрации текстур TF, тогда как в G80 при таком же количество модулей фильтрации модулей адресации было вдвое меньше.

Указанное архитектурное изменение было опробовано ещё в чипах G84 и G86, которые легли в основу предыдущих решений среднего и начального уровня. Однако, несмотря на то, что TMU в G80 способны выполнять в два раза большее количество текстурных выборок за такт, на практике в реалистичных сценариях (при включенной трилинейной или анизотропной фильтрации) производительность будет упираться в скорость работы модулей фильтрации, которых у GeForce 8800 GTX всё же больше.

Блоки ROP, каждый из которых обрабатывал по-прежнему по четыре пикселя, так же не изменились, уменьшилось лишь их количество — в G80 их было 6, а в новом решении осталось всего 4. Такого количества блоков ROP на практике оказалось достаточно для актуальных на тот момент разрешений экранов, а себестоимость чипов удалось снизить. Кроме того, это позволило при лишь немного возросшем транзисторном бюджете перенести микросхему NVIO, ответственную за поддержку внешних интерфейсов, в сам чип. Скажем сразу, что ни переносом чипа NVIO в графический процессор, ни усложнением блоков TMU, ни вероятным увеличением кэшей при переходе на более узкую 256-битную шину объяснить всё-таки возросшее с 681 до 754 млн количество транзисторов было невозможно. С самого начала выглядело крайне вероятным, что G92 в составе GeForce 8800 GT всё же несколько урезан, так что чуть позже нас, возможно, ждёт выпуск более производительного решения на полноценном G92. Так в итоге и получилось, но об этом расскажем в другой раз.

реклама

Из менее существенных для игровой производительности нововведений можно отметить ещё обновленный встроенный видеопроцессор, который теперь был способен уже почти полностью разгружать CPU при декодировании большинства актуальных форматов видеоданных, включая "тяжелые" варианты H.264, MPEG-2 и VC-1, и поддержку PCI Express 2.0. Вторая версия PCI Express, конечно, увеличивала стандартную пропускную способность этого интерфейса в два раза (с 2.5 Гбит/с до 5 Гбит/с на канал), однако, для GeForce 8800 GT такие цифры пропускной способности и не требовались. Зато это добавляло головной боли в виде проблем (пускай и редких) с совместимостью на некоторых материнских платах, несмотря на то, что по стандарту PCI-E 2.0 была заявлена обратная совместимость с PCI-E 1.0 и 1.1.

Основным же преимуществом нового ускорителя была его цена — NVIDIA установила стоимость 8800 GT с 512 МБ памяти на отметке всего в $250! Для ускорителя, который исходя из спецификации, должен был оказаться где-то между GeForce 8800 GTS и 8800 GTX, причём, ближе к последней, такая цена была по-настоящему "вкусной". Конечно, на старте продаж да ещё и с учётом огромного по понятным причинам спроса, фактическая стоимость GeForce 8800 GT достигала $300, а порой и выше, но даже за эти деньги новый продукт NVIDIA был хорош.

В нашем тестировании принимает участие карточка от американской XFX, которая уже многие годы выпускает ускорители только на чипах AMD, но в былые время были в ассортименте компании и продукты на чипах NVIDIA. Основные отличия XFX GeForce 8800 GT Alpha Dog Edition (PV-T88P-YDQ4) от референсной 8800 GT — печатная плата чёрного цвета, вентилятор большего диаметра, металлическое ребро жёсткости вдоль наружного края печатной платы с логотипом компании-производителя, декоративная наклейка на пластиковом кожухе системы охлаждения и небольшой заводской разгон.

Как и референсная GeForce 8800 GT, карта XFX требует лишь одного 6-пинового кабеля дополнительного питания, имеет однослотовую систему охлаждения и снабжена парой гнезд DVI-I с поддержкой Dual Link. Тепловыделение карты несмотря на более тонкий техпроцесс внушительное (125 Вт), так что кулер под нагрузкой выходит на очень высокие обороты, что приводит к высокому же уровню шума. При этом важно отметить, что карта горячая такая же горячая, как и предыдущие 90-нм продукты даже при тестировании на открытом стенде. Но нам куда интереснее игровая производительность.

Тесты

реклама

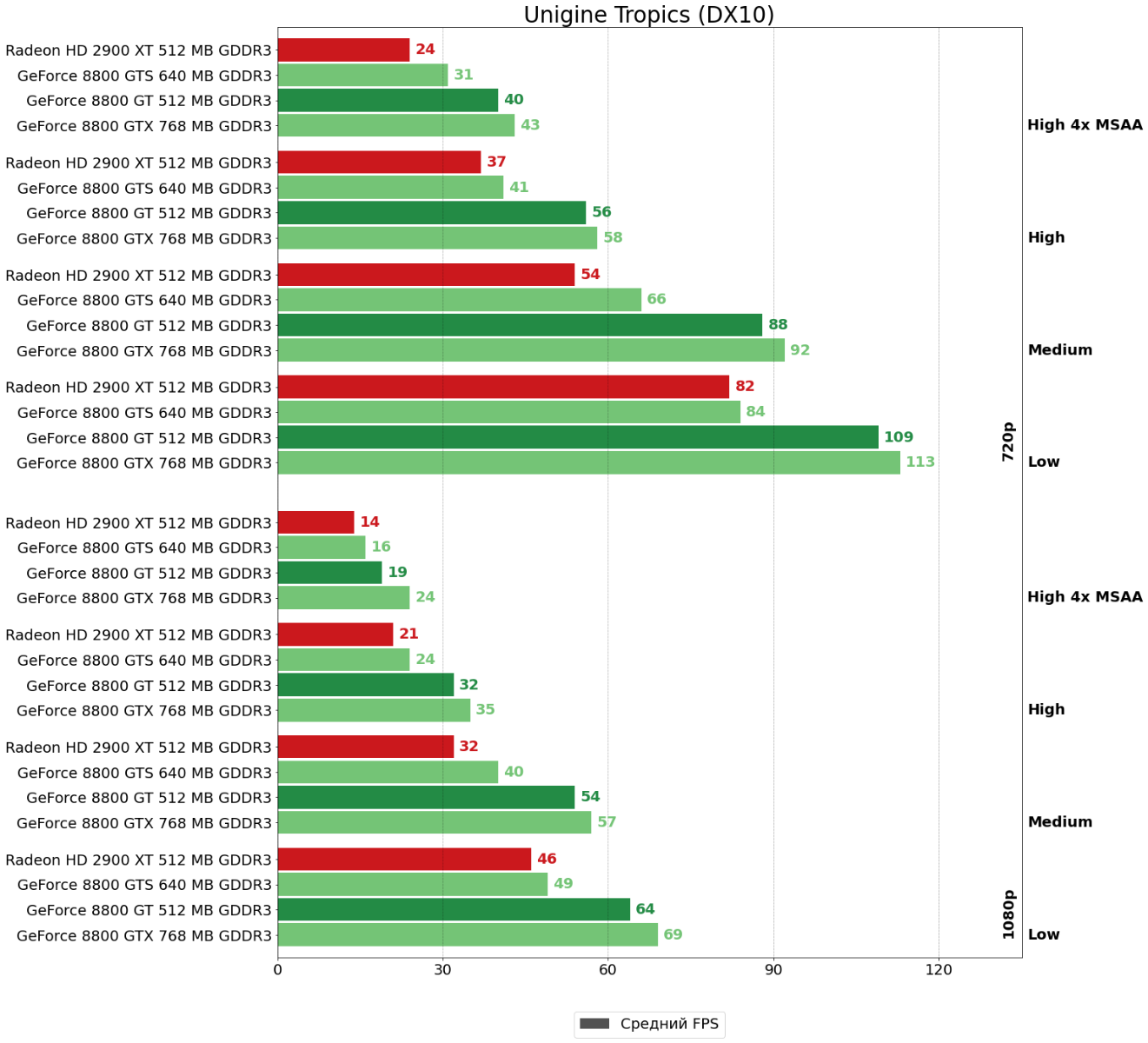

Unigine Tropics

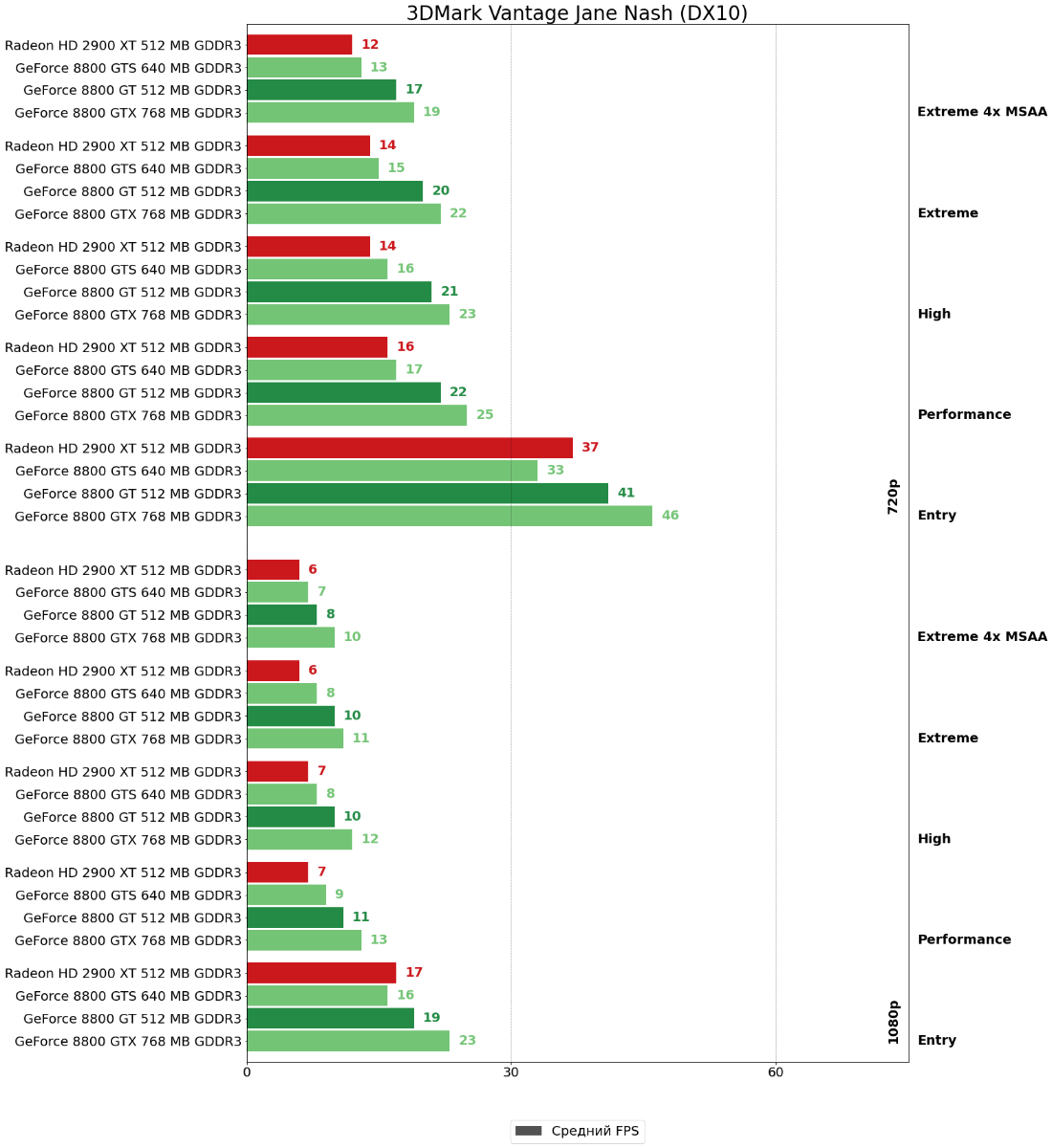

3DMark Vantage

3DMark Cloud Gate

Начинаем традиционно с синтетических DirectX 10 тестов UNIGINE и UL (бывшая Futuremark), где наблюдаем ожидаемую картину — GeForce 8800 GT находится между GeForce 8800 GTS и 8800 GTX, правда, значительно ближе к последней. Если подобная расстановка сил будет наблюдаться и в играх, то это станет однозначной победой 8800 GT за счёт преимущества в стоимости на момент выхода.

реклама

Call of Juarez (Chrome Engine 3, 2007)

В первом реальном игровом проекте GeForce 8800 GT действительно почти догоняет GeForce 8800 GTX, пускай и справляется всё же заметно хуже в более высоком разрешении.

Crysis (CryEngine 2, 2007)

Да что там паритет с 8800 GTX, в бенчмарке всех времён 8800 GT местами даже немного впереди!

Far Cry 2 (Dunia Engine, 2008)

Аналогичная картина и в Far Cry 2 — GeForce 8800 GT действительно нет-нет, да и обойдёт соперника в лица 8800 GTX. Впрочем, может и чуть-чуть отстать, но разница между ускорителями в любом случае чисто номинальная. Разница по производительности, но не по стоимости, прошу ещё раз заметить.

S.T.A.L.K.E.R. Call of Pripyat (X-Ray Engine 1.6, 2009)

А вот в крайней части серии игр S.T.A.L.K.E.R. победа всё же по-прежнему очевидным образом остаётся за GeForce 8800 GTX, пускай преимущество и не столь существенно.

Metro 2033 (4A Engine, 2010)

В Metro 2033 видим почти абсолютный паритет между GeForce 8800 GT и 8800 GTX — в HD-разрешении совсем немного впереди первый ускоритель, а в FHD уже второй.

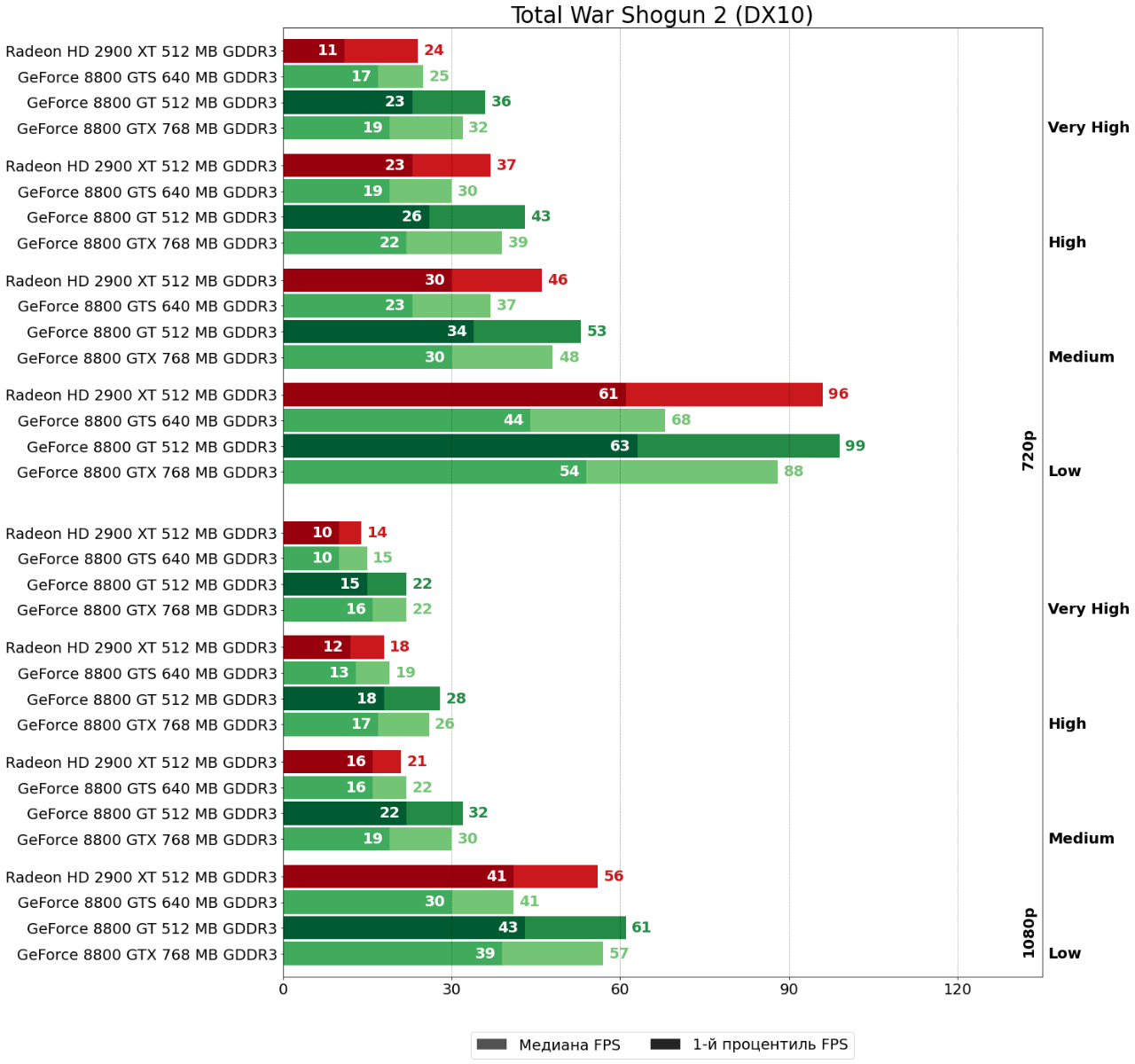

Total War Shogun 2 (TW Engine 3, 2011)

А в Total War Shogun 2 однозначно впереди новенькая (на конец 2007 года) GeForce 8800 GT.

Sniper Elite V2 (Asura Eingine, 2012)

Во второй части Sniper Elite, напротив, GeForce 8800 GTX всё ещё удаётся удержать позиции и не пасть под напором наглого новичка.

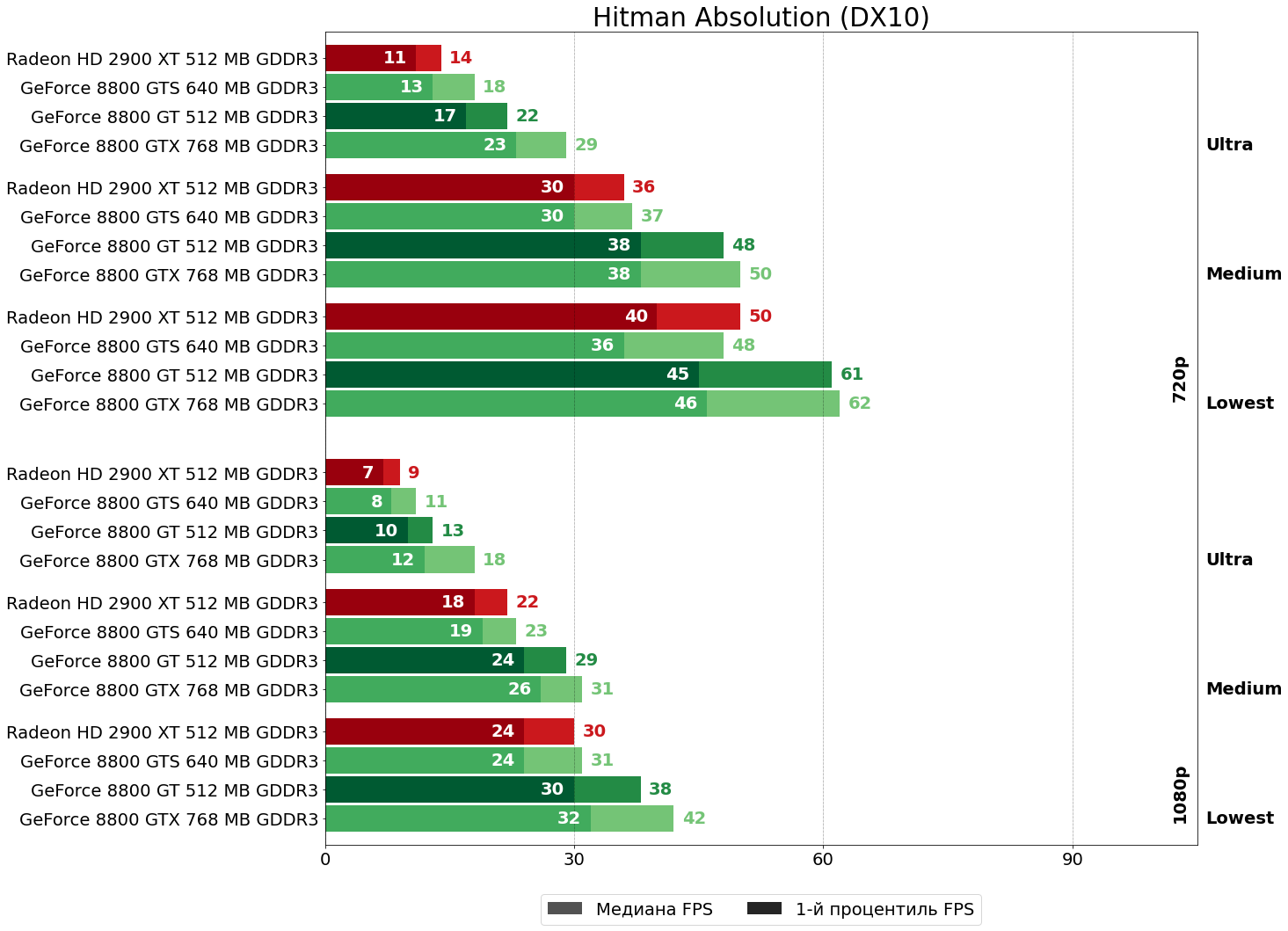

Hitman Absolution (Glacier 2, 2012)

В Hitman Absolution некоторое преимущество за GeForce 8800 GTX всё ещё сохраняется, но уже почти на гране погрешности за исключением ультра-настроек.

BioShock Infinite (Unreal Engine 3, 2013)

В BioShock Infinite в общем и целом между GeForce 8800 GT и 8800 GTX вновь наблюдается паритет — где-то на пару FPS быстрее одна карта, где-то другая.

Tomb Raider (Crystal Engine, 2013)

Уж кому-кому, а умной, спортивной и бесстрашной Ларе Крофт должно быть по душе всё новое. Так и получилось — GeForce 8800 GT выступила на уровне 8800 GTX, местами даже чуть лучше.

F1 2014 (EGO Engine, 2014)

Впрочем, и более консервативная королева автоспорта так же благоволит новенькой GeForce 8800 GT, разве что на ультра-настройках в FHD 8800 GTX ещё есть, чем ответить, но это такое.

Grand Theft Auto V (RAGE, 2015)

И, наконец, в GTA V чаша весов склоняется по-прежнему в сторону GeForce 8800 GTX, впрочем в единственном по сути реалистичном сценарии (минимальные настройки в HD-разрешении) наблюдается паритет.

Среднегеометрические результаты

Подытожим. В среднем в самом худшем случае GeForce 8800 GT отстал в протестированных играх от 8800 GTX на пару жалких FPS, что вообще несущественно, а в реалистичных сценариях наблюдается практически абсолютный паритет. И это при минимум двукратном преимуществе в реальной розничной стоимости.

Конечно, GeForce 8800 GT не был лишён объективных недостатков. Так, например, ставшая зачем-то однослотовой система охлаждения столь производительного ускорителя на практике показала себя шумной и неэффективной. Были у 8800 GT и проблемы с доступностью в розничных сетях, впрочем, дефицит был, скорее, следствием фантастического соотношения цена-производительность и полного отсутствия конкурентов за туже цену.

Выводы

- На старте продаж в актуальных на тот момент играх GeForce 8800 GT фактической стоимостью в $300 демонстрировал производительность практически равную вдвое более дорогому ускорителю GeForce 8800 GTX. С годами ситуация, как мы убедились, так же не изменилась. На сравнение с Radeon HD 2900 XT и GeForce 8800 GTS можно вообще не тратить времени (как, собственно, и было сделано) — эти ускорители попросту находятся на ступень ниже по производительности. Там же они находились и в момент выхода GeForce 8800 GT, при этом стоили дороже последней!

- Справедливости ради, нужно отметить, что у AMD имелся в продаже ещё ускоритель Radeon HD 2900 PRO, представлявший собой почти точную копию Radeon HD 2900 XT с несколько заниженными тактовыми частотами и заявленной ценой аж на $150 ниже ($249 против $399). При этом абсолютное большинство экземпляров HD 2900 PRO спокойно работали на частотах HD 2900 XT, что делало это предложение крайне выгодным. Вот только жизнь этой карте была уготована очень короткая, ибо RV670 уже был “на подходе”, так что карт HD 2900 PRO было выпущено мало, так что и дефицит, и фактические розничные цены были высокими.

- Вообще, выход GeForce 8800 GT — это, к огромному сожалению, один из редких примеров в современной истории компьютерной индустрии, когда новый средне-бюджетный продукт просто уничтожает все предыдущие топовые и предтоповые продукты, делая их покупку по актуальным ценам абсолютно бессмысленной. Причём, GeForce 8800 GT уничтожил в этом смысле не только единственную производительную карту конкурента (Radeon HD 2900 XT), но до кучи и все предложения самой NVIDIA — как оба варианта 8800 GTS, так и 8800 GTX.

- "К сожалению" говорю потому, что именно таких продуктов, мы, простые люди (имя нам — легион!) и ждём в каждом новом поколении. Не прибавки в жалкие 10%, ни магических (но по большей части не видимых) лучей, ни HBM-памяти с заоблачными (но чисто теоретическими) показателями пропускной способности, которые на практике ещё и мало что дают. Просто дайте нам карту в 2 раза дешевле, но близкую по производительности к топам прошлого поколения, а не вот это всё, что выше перечислено и иже с ним, да ещё и за "оверпрайс". Да, да, знаю, губозакаточная машинка на месте, уже включаю...

- Важно так же отметить, что выкатить подобную карту в 2007 году NVIDIA не помешала ни конкуренция по сути с самой собой, ни только что состоявшийся переход на принципиально новую (унифицированную шейдерную) архитектуру. То есть, получается, могут же, когда захотят, а значит, вопрос не в том, почему не могут, а почему не хотят. Впрочем, ответы на подобного рода вопросы, по всей видимости, были даны уже очень давно. Как там было то у Ильфа "наших" с Петровым? "Но старушки кушают! И с большим удовольствием!"

P.S. Сидим тихо, ждём RTX 3060 (Ti/Super) "за недорого".

Предыдущие обзоры

Лента материалов

Соблюдение Правил конференции строго обязательно!

Флуд, флейм и оффтоп преследуются по всей строгости закона!

Комментарии, содержащие оскорбления, нецензурные выражения (в т.ч. замаскированный мат), экстремистские высказывания, рекламу и спам, удаляются независимо от содержимого, а к их авторам могут применяться меры вплоть до запрета написания комментариев и, в случае написания комментария через социальные сети, жалобы в администрацию данной сети.