Галерея мульти-GPU видеоадаптеров. Часть 2

Как обычно немного истории: Дженcен Хуанг, Кертис Прэм и Крис Малачовски основали компанию NVIDIA в апреле 1993 года в штате Калифорния, США. Первый графический чип увидел свет в 1995 году. Назывался он NV1 и производился компанией SGS-THOMSON Microelectronics под именем STG-2000, а видеокарты были известны в основном под маркой Diamond Edge 3D. NV1 был первым доступным 3D-ускорителем для IBM PC-совместимых машин, все остальные конкурирующие ускорители появились на рынке с отставанием в полгода. Во многом STG-2000 была принципиально новым продуктом: на печатной плате одновременно размещались 2D-карта и 3D-ускоритель, звуковая карта и специальный порт для игровых контроллеров Sega Saturn. Подключалась видеокарта посредством интерфейса PCI, а объем встроенной памяти стандарта EDO равнялся 2 Мб, однако на некоторых моделях его можно было расширить до 4 Мб после установки дополнительной платы расширения. Но были у видеокарты и серьёзные проблемы: качество 2D графики было весьма посредственным и она не могла соперничать с более дешёвой и популярной продукцией той же S3. Наличие же встроенного звукового чипа, пусть и обладавшего рядом интересных особенностей, в эпоху тотального преобладания проверенных и недорогих решений конкурентов тоже не давало решающего преимущества. Отдельно стоить поговорить о 3D составляющей NV1: видеопроцессор использовал необычное квадратичное наложение текстур (quadratic texture mapping, QTM) вместо принятой сегодня технологии на основе полигонов, и интерес рынка к продукту окончательно угас, когда Microsoft объявила о спецификациях DirectX, так некстати для NVIDIA основанном на традиционном полигональном рендеринге. Попытка исследовательской группы NVIDIA портировать квадратичную технологию на API Microsoft провалилась, также как провалилась и попытка добавить ограниченную поддержку Direct3D, ввиду её медлительности, вызванной использованием программной обработки. DirectX API был "фундаментально" несовместим с NV1 и означал неизбежную смерть видеокарты как продукта для массового рынка. Масла в огонь подлил и провал Sega Saturn в сравнении с Sony Playstation, так что уникальная совместимость с его контроллерами тоже не смогла сыграть на руку NVIDIA. Дальнейшие работы по NV1 были спешно свёрнуты, а разработка следующего поколения видеочипов NV2, которые должны были стать частью новой консоли Sega Dreamcast - остановлена. NVIDIA была вынуждена полностью отказаться от QTM в пользу полигонального рендеринга в своих будущих продуктах.

реклама

В 1997 году NVIDIA выпустила видеочип NV3, который более известен как Riva 128, кстати, само название Riva - акроним от Real-time Interactive Video and Animation accelerator. В этот раз компания решила не наступать на те же грабли и изначально обеспечила новой видеокарте максимальную совместимость с Direct3D, а позже и с OpenGL. Графический процессор изготавливался с применением 350-нм тех. процесса и содержал 3,5 миллиона транзисторов. Видеокарта использовала память типа SGRAM, объем которой составлял 4 Мбайт, а частота — 100 МГц. Ширина шины памяти составляла 128 бит. В отличие от видеокарты Voodoo Graphics, Riva 128 работала как через интерфейс PCI, так и через новейший на то время AGP. В 3D приложениях видеокарта была несколько медленнее, чем её основной конкурент, однако при этом она сочетала в себе одновременно 2D и 3D графические чипы, что положительно сказывалось на общей стоимости видеосистемы. Еще одним конкурентным преимуществом была поддержка более высоких разрешений, NV3 позволял выводить 3D изображение в разрешениях вплоть до 800x600 и 960x720, в то время, как Voodoo Graphics ограничивалась лишь 640х480. Всё это обеспечило видеокарте популярность среди OEM производителей. Однако были у Riva 128 и недостатки. Изначально видеокарта использовала наиболее выгодное с точки зрения количества вычислений по-полигонное MIP текстурирование, вместо более качественного по-пиксельного. Как результат - резкая и неожиданная смена качества прорисовки на объектах, в те моменты времени, когда происходила замена LOD на текстуре, будь то перемещение самой точки наблюдения или перемещение полигона, относительно точки наблюдения. Недоработку исправили выпуском обновленной версии драйверов, в которых NVIDIA отдельно добавила поддержку режима по-пиксельного MIP текстурирования. Были недостатки и в работе билинейной фильтрации, которая сама по себе хоть и обеспечивала большую, чем у Voodoo Graphics, резкость картинки, но при этом добавляла текстурам незначительные графические артефакты, попутно проявляя едва различимые швы между соседними полигонами. Нельзя не отметить и отсутствовавшую изначально поддержку OpenGL и движка Unreal Engine в Direct3D режиме. И если первую проблему решили выпуском обновленной версии Riva 128 ZX с увеличенным до 8 Мб объемом видеопамяти, то из-за второй всё равно приходилось мириться с низкой производительностью, так как Direct3D по прежнему не работал, а производительность в OpenGL оставляла желать лучшего.

На выход  Voodoo² в 1998 году NVIDIA подготовила достойный ответ в лице Riva TNT. Новый чип, имевший кодовое название NV4, был изготовлен по старому 350-нм технологическому процессу и содержал 7 миллионов транзисторов. В сравнении с Riva 128 был добавлен второй пиксельный процессор, что практически удвоило скорость рендеринга, к тому же использовалась более быстрая память, а на смену DirectX 5.0 пришел DirectX версии 6.0. Видеокарта по прежнему поддерживала одновременно 2D и 3D графику и могла похвастать 128 битной шиной памяти, суммарный объем видеопамяти стандарта SDRAM равнялся 16 Мбайт, а её частота возросла до 110 МГц. Особенностью видеокарты была поддержка 32-битного цвета и текстур с разрешением вплоть до 1024x1024 пикселей, хотя при активации 32-битного цвета, разрекламированного самой NVIDIA, производительность падала на 20-40% в зависимости от разрешения. У несколько запоздавшей ATI Rage 128 при этом подобной проблемы не наблюдалось. Также NV4 обзавелся поддержкой фирменной технологии Twin-Texel, которая позволяла накладывать две текстуры на один пиксель за такт в режиме мультитекстурирования, благодаря ей скорость заполнения выросла примерно на 40%, а применение именно этой технологии отражено в названии Riva TNT. Изначально видеокарта была нацелена на то, чтобы превзойти Voodoo² по скорости, однако из-за большого нагрева тестовых образцов пришлось снижать частоту графического процессора с планировавшихся 110 МГц до 90 МГц, которых оказалось недостаточно для успешного противостояния с 3dfx. К тому же на тот момент множество игр выпускалось исключительно с поддержкой Glide API, в котором владельцы карт NVIDIA не обладали никакими преимуществами, а сами Voodoo² поддерживали режим SLI, активация которого поднимала планку производительности до недостижимого уровня. Немногим позже для Riva TNT был выпущен новый видеодрайвер под брендом - Detonator. В нем была добавлена поддержка оптимизаций 3DNow!, благодаря которым возросла производительность в ряде OpenGL и DirectX приложений, в частности количество кадров в Quake2 выросло на 30%. В 1999 году NV4 был немного доработан и переведен на 250-нм тех. процесс. Видеокарта обзавелась поддержкой текстур разрешением до 2048х2048, порт AGP 4x пришел на смену AGP 2x, частота графического процессора возросла до 150 МГц, а видеопамяти до 183 МГц, при этом до 32 Мб возрос и её объем. Видеочип сменил маркировку на NV5, а сама карта приобрела двойку в названии и выпускалась в двух вариантах: Riva TNT2 и Riva TNT2 Ultra, отличались они лишь тактовыми частотами. Позже была добавлена промежуточная версия в лице Riva TNT2 Pro и более дешевые варианты под названием Vanta, Vanta LT и Riva TNT2 M64 с урезанной до 64-бит шиной памяти.

Voodoo² в 1998 году NVIDIA подготовила достойный ответ в лице Riva TNT. Новый чип, имевший кодовое название NV4, был изготовлен по старому 350-нм технологическому процессу и содержал 7 миллионов транзисторов. В сравнении с Riva 128 был добавлен второй пиксельный процессор, что практически удвоило скорость рендеринга, к тому же использовалась более быстрая память, а на смену DirectX 5.0 пришел DirectX версии 6.0. Видеокарта по прежнему поддерживала одновременно 2D и 3D графику и могла похвастать 128 битной шиной памяти, суммарный объем видеопамяти стандарта SDRAM равнялся 16 Мбайт, а её частота возросла до 110 МГц. Особенностью видеокарты была поддержка 32-битного цвета и текстур с разрешением вплоть до 1024x1024 пикселей, хотя при активации 32-битного цвета, разрекламированного самой NVIDIA, производительность падала на 20-40% в зависимости от разрешения. У несколько запоздавшей ATI Rage 128 при этом подобной проблемы не наблюдалось. Также NV4 обзавелся поддержкой фирменной технологии Twin-Texel, которая позволяла накладывать две текстуры на один пиксель за такт в режиме мультитекстурирования, благодаря ей скорость заполнения выросла примерно на 40%, а применение именно этой технологии отражено в названии Riva TNT. Изначально видеокарта была нацелена на то, чтобы превзойти Voodoo² по скорости, однако из-за большого нагрева тестовых образцов пришлось снижать частоту графического процессора с планировавшихся 110 МГц до 90 МГц, которых оказалось недостаточно для успешного противостояния с 3dfx. К тому же на тот момент множество игр выпускалось исключительно с поддержкой Glide API, в котором владельцы карт NVIDIA не обладали никакими преимуществами, а сами Voodoo² поддерживали режим SLI, активация которого поднимала планку производительности до недостижимого уровня. Немногим позже для Riva TNT был выпущен новый видеодрайвер под брендом - Detonator. В нем была добавлена поддержка оптимизаций 3DNow!, благодаря которым возросла производительность в ряде OpenGL и DirectX приложений, в частности количество кадров в Quake2 выросло на 30%. В 1999 году NV4 был немного доработан и переведен на 250-нм тех. процесс. Видеокарта обзавелась поддержкой текстур разрешением до 2048х2048, порт AGP 4x пришел на смену AGP 2x, частота графического процессора возросла до 150 МГц, а видеопамяти до 183 МГц, при этом до 32 Мб возрос и её объем. Видеочип сменил маркировку на NV5, а сама карта приобрела двойку в названии и выпускалась в двух вариантах: Riva TNT2 и Riva TNT2 Ultra, отличались они лишь тактовыми частотами. Позже была добавлена промежуточная версия в лице Riva TNT2 Pro и более дешевые варианты под названием Vanta, Vanta LT и Riva TNT2 M64 с урезанной до 64-бит шиной памяти.

Самая первая видеокарта семейства GeForce утвердила компанию NVIDIA в роли лидера рынка дискретных графических решений и была впервые представлена 31 августа 1999 года. GeForce 256 была наиболее продвинутым графическим ускорителем своего времени. Основной особенностью видеокарты стало внедрение технологии Transform and Lighting (T&L, трансформация и освещение), которая отвечала за обработку освещения и трансформации объектов в реальном времени, прежде эти функции исполнял центральный процессор. Во многом благодаря движку T&L производительность GeForce 256 в некоторых играх могла быть значительно выше, нежели у конкурентов и предшественников. Критики справедливо заявляли, что внедрение T&L было сильно переоценено и что в ряде случаев достаточно быстрый процессор мог обсчитывать геометрические расчеты не хуже, чем графический чип. К тому же ранние драйверы испытывали некоторые проблемы с производительностью и стабильностью, а программисты не очень-то и торопились внедрять поддержку новой технологии и тянули кота за хвост вплоть до выхода на рынок GeForce 2 и Radeon R100. Что касается самого видеочипа NV10, то выпускался он по 220-нм технологии, этим объясняются столь низкие тактовые частоты, а из-за высокого тепловыделения приходилось в обязательном порядке использовать активное охлаждение графического процессора. Из нового - наконец-то появилась поддержка MPEG2, DirectX 6.0 уступил место более новому DirectX 7.0, а количество пиксельных процессоров, текстурных блоков и блоков растеризации относительно предшественника было удвоено. GeForce 256 выпускался в двух вариантах - со старой памятью SGRAM и с новой высокочастотной DDR. В плане производительности в системах с использованием бюджетных процессоров новинка демонстрировала подавляющее преимущество над Voodoo3 и Riva TNT2, однако как только процессор заменялся на более быстрый, разрыв сильно сокращался.

реклама

В начале 2000 года был представлен новый видеочип NV15 и семейство видеокарт GeForce 2, которое базировалось на его основе. Архитектура NV15 во многом повторяла своего предшественника, но были и существенные отличия. Новый видеочип содержал в себе 25 миллионов транзисторов и выпускался по более тонкому 180-нм технологическому процессу, что позволило значительно увеличить частоту графического чипа. Количество пиксельных процессоров не изменилось, однако теперь на каждый из них приходилось по два текстурных блока, что позволяло видеокарте накладывать до 8 текстур за такт и удвоило скорость выборки текстурных данных до 1,6 Гигатекселей в секунду, отсюда и название GTS - GigaTexel Shader. Нельзя не отметить и появление технологии NSR (Nvidia Shading Rasterizer), которая позволяла рассчитывать затенение отдельных пикселей практически без потери производительности. Так же как и предшественник, NV15 поддерживал T&L, за год его работа была оптимизирована, а производительность при отрисовке геометрических объектов и освещения выросла примерно на 30%. Из недостатков - видеокарты страдали от недостаточной производительности подсистемы памяти и неважной реализации технологии Z-буферизации. Помимо старшей версии с приставкой GTS, NVIDIA вывела на рынок целую гамму различных решений для всех сегментов рынка. Это и более быстрые GeForce 2 Pro, Ti и Ultra, отличавшиеся повышенными тактовыми частотами, и бюджетные видеокарты семейства GeForce 2 MX, которые пришли на смену подешевевшим Riva TNT2 для противостояния с недорогими ATI Radeon 7000 и Radeon SDR. От GeForce 2 GTS они отличалась тем, что у них была отключена половина пиксельных процессоров и текстурных блоков, уменьшена частота ядра, а быстрая DDR память заменена недорогой памятью типа SDR, кроме этого, выпускались и 64-битные версии видеокарты GeForce 2 MX. В остальном она поддерживала такие же технологии, как и GTS.

Видеочип NV20 был первым в мире графическим решением, поддерживавшим библиотеки Microsoft Direct3D 8.0. Видеокарта GeForce 3 на его основе была впервые представлена в рамках конференции Macworld в январе 2001 года, где она использовалась для демонстрации работы технодемки Junior Lamp от Pixar и Doom 3 от id software. Сам графический процессор выпускался по обновленному 150-нм техпроцессу и претерпел значительные изменения. Новшеством была поддержка движка nFinite FX Engine. Его появление означало, что видеокарты GeForce 3 теперь поддерживали пиксельные и вершинные шейдеры, которые позволяли создавать огромное количество различных спецэффектов. Другой особенностью NV20 являлась улучшенная архитектура памяти под названием LMA (Lightspeed Memory Architecture), которая включала несколько особых механизмов, призванных частично разгрузить подсистему памяти посредством сжатия данных, читаемых и/или записываемых в Z-буфер, подобно технологии ATI HyperZ. Шина памяти новых ускорителей осталась 128-битной, однако теперь она состояла из четырех 32-битных контроллеров, тогда как GeForce 2 использовали один, 128-битный. Особенно эффективна такая система была в детализированных сценах. Видеокарта поддерживала новые алгоритмы сглаживания MSAA (Multi-Sampling Anti-Aliasing) и Quincunx, которые демонстрировали более высокую производительность, нежели SSAA (Super-Sampling Anti-Aliasing) ценою ухудшения качества изображения. При использовании MSAA сглаживались лишь кромки полигонов, а не всё изображение целиком. Это благотворно сказывалось на общей производительности, но при определенном расположении границ полигона к наблюдателю эффект от использования подобного типа сглаживания сильно уменьшался, также MSAA не работало на частично прозрачных поверхностях. Quincunx же был своего рода блюр-фильтром, который смещал исходную картинку на пол пикселя вверх и влево, чтобы создать суб-пиксели с усредненным цветом. Затем шло наложение двух изображений, острые кромки частично исчезали, но изображение получалось менее детализированным и добавлялось размытие. Помимо новых алгоритмов сглаживания карта поддерживала 8х анизотро́пную фильтра́цию, против 2х у предшественницы. По производительности GeForce 3 нередко отставал от GeForce 2 Ultra, ведь конфигурация самого видеочипа не изменилась, в то время как у Ultra версии были на четверть более высокие частоты. Но всё менялось, когда в дело вступало полноэкранное сглаживание: благодаря новым алгоритмам производительность GeForce 3 падала не так значительно, как у GeForce 2 и она вырывалась вперед. Осенью 2001 года NVIDIA расширила модельный ряд GeForce 3 выпуском двух новых вариантов - GeForce 3 Ti 200 и Ti 500. Первая отличалась пониженными частотами ядра и памяти, у второй же наоборот частоты было серьёзно повышены. Более ничем от оригинальной карты они не отличались.

Семейство видеокарт GeForce 4 было представлено в начале 2002 года. Графический чип NV25 архитектурно повторял NV20 и содержал 63 миллиона транзисторов, выпуск вёлся с использованием 150-нм технологического процесса. Помимо повышенных частот Geforce 4 мог похвастать удвоенным количеством вершинных шейдеров и поддержкой технологии Pixel Shader версии 1.3. Движок nFinite FX Engine и LMA(Lightspeed Memory Architecture)были доработаны, так же появилась возможность проигрывания DVD и одновременная поддержка двух мониторов, которая перекочевала прямиком с GeForce 2MX. Изначально выпускалось две версии видеокарты: GeForce 4 Ti4400 и Ti4800, которые отличались лишь тактовыми частотами. С выпуском более дешевой версии было решено немного повременить, чтобы партнеры NVIDIA получили возможность распродать имевшиеся складские запасы стремительно устаревающих GeForce 3 Ti200 и Ti500. Однако агрессивная ценовая политика ATI с её Radeon 8500 и 8500LE вынудили NVIDIA изменить своё решение и спешно выводить на рынок GeForce Ti4200. Для того, чтобы избежать внутренней конкуренции с более дорогими картами серии, частота памяти у Ti4200 была снижена до 222 МГц. Обновился и бюджетный сектор, на смену GeForce 2MX пришло семейство 4MX. Обновленная линейка GeForce 4МХ не поддерживала новейший DirectX 8.0 с пиксельными шейдерами, однако она всё же могла похвастать новым 2-х канальным контроллером памяти с поддержкой технологии LMA и продвинутыми режимами сглаживания Accuview, кроме того имелся блок VPE (Video Processing Engine) для декодирования MPEG-2 и полноценная поддержка двух мониторов. Подросли и тактовые частоты, медленная память SDR была заменена более быстрой DDR. Через год вышел обновленный видеочип NV28, который добавлял поддержку AGP 8x. Ti4200 была переименована в Ti4200 8x, Ti4400 в Ti4800SE, а Ti4600 в Ti4800, частоты при этом оставались прежними.

Графический чип NV30 был представлен широкой публике в конце января 2003 года. Сам чип выпускался с использованием 130-нм технологического процесса и содержал в себе 125 миллионов транзисторов. Семейство видеоадаптеров, выпускавшихся на основе NV30, получило название GeForce FX и было представлено двумя моделями: GeForce FX 5800 и 5800 Ultra, которые отличались лишь тактовыми частотами. Особенностью видеокарт была поддержка Microsoft DirectX 9.0 и Shader Model 2.0, а также технологии Ultra Shadow. Помимо этого были доработаны алгоритмы сглаживания и оптимизирована работа подсистемы памяти. Правда из-за узкой 128-битной шины инженерам NVIDIA пришлось прибегнуть к использованию более дорогой памяти DDR2, которая, к тому же, обладала весьма горячим нравом. Блок VPE (Video Processing Engine), предназначенный для кодирования видео в формате MPEG2, перекочевал в карту из младшей серии МХ4. Несмотря на все новшества, видеокарта была раскритикована как за невысокую производительность, так и за свои неважные потребительские свойства. А из-за специфического внешнего вида и шумовых характеристик фирменной системы охлаждения Flow FX, она получила обидное прозвище "пылесос". Вышедший полугодом ранее Radeon 9700 Pro мало того, что обладал меньшим потреблением и тепловыделением, так еще и не оставлял ни единого шанса детищу NVIDIA в приложениях, использовавших новый Shader Model 2.0. В срочном порядке на обновленном видеочипе NV35 была выпущена GeForce FX 5900 Ultra c 256-битной шиной памяти и улучшенной производительностью вершинных шейдеров. Одновременно были выпущены бюджетные модели FX 5600 и 5200, особенностью которых было то, что в некоторых приложениях они умудрялись проигрывать старой GeForce 4 Ti4200, а в случае FX 5200 и вовсе МХ440. Несмотря на неудачный старт, серия FX получила дальнейшее развитие. Осенью была выпущена GeForce FX 5950 Ultra и GeForce FX 5700 Ultra, в последней использовалась память GDDR2. Начало 2004 года ознаменовалось выпуском GeForce PCX 5950 и GeForce PCX 5750, начался постепенный переход индустрии на стандарт PCI Express.

Видеокарты GeForce 6-й серии были призваны вернуть компании лидирующее положение на рынке дискретных графических решений, которое пошатнулось после провального старта линейки ускорителей GeForce FX и, надо сказать, у них это почти получилось! Инженеры NVIDIA провели блестящую работу над ошибками и новый графический чип NV40 по всем статьям превосходил своего предшественника NV30/35. В четыре раза увеличилось количество пиксельных процессоров и блоков растеризации, в два раза количество вершинных процессоров и блоков текстурирования. Производительность GeForce 6800 Ultra в 2-2,5 раза превосходила таковую у GeForce 5950 Ultra при том, что она выпускалась в рамках всё того же 130-нм технологического процесса и даже несколько убавила в плане энергопотребления, однако до Radeon X800 XT Platinum Edition она все-таки немного не дотягивала. Частота видеоядра были несколько меньше, чем у предыдущего флагмана, однако при этом использовалась более быстрая и совершенная GDDR3 видеопамять объемом 256 Мб, через некоторое время была выпущена 512 Мб версия карты. Выпускались варианты как с поддержкой порта AGP, так и с поддержкой нового PCI-Express 16x. Все видеокарты 6-й серии поддерживали новейшие Shader Model 3.0 и DirectX 9.0, а также технологию PureVideo, которая переносила нагрузку по перекодированию и последующей обработке видео с центрального процессора на видеокарту. Впервые со времён 3dfx появилась возможность объединять пару графических карт в рамках одной системы с целью повышения производительности, называлась технология NVIDIA SLI (Scalable Link Interface). В среднем ценовом сегменте безраздельно властвовал NV43 и основанная на нем GeForce 6600GT. Видеокарта была представлена чуть позже, чем старшие решения и представляла из себя половинку от GeForce 6800GT с поддержкой всех фирменных технологий. На неё, как и на флагманы, ставилась быстрая GDDR3 память, а благодаря более тонкому 110-нм технологическому процессу видеокарта изначально обладала довольно высокими частотами и неплохо поддавалась разгону. Производительность GeForce 6600GT была настолько высокой, что она с лёгкостью опережала старшие решения предыдущего поколения в лице Radeon 9800 Pro и GeForce 5900 Ultra. Самый младший представитель семейства - GeForce 6200 производительностью не блистал, однако получил поддержку технологии Turbo cache, которая частично компенсировала малый объем видеопамяти в 64 Мб. Она позволяла карте заимствовать часть оперативной памяти под свои нужды, когда собственная видеопамять заканчивалась. Партнерами NVIDIA было выпущено великое множество модификаций GeForce 6600, а GeForce 6800 и 6800LE были первыми и последними видеокартами компании, в которых можно было легко и непринужденно активировать заблокированные конвееры и, в случае их работоспособности, бесплатно получить хорошую прибавку к производительности.

Седьмая серия GeForce была представлена летом 2005 года и являлась эволюционным развитием предшествовавшей ей шестой. Кодовое название графического процессора изменилось на G70, он изначально проектировался с расчетом на использование PCI-E стандарта, а выпуск вёлся с использованием проверенного 110-нм технологического процесса. В каждый конвейер были добавлены дополнительные блоки ALU, которые отвечали за обработку наиболее популярных пиксельных шейдеров. При этом число самих конвейеров и блоков текстурирования было увеличено до 24 штук, прибавилась и пара вершинных шейдеров. Были проведены оптимизации алгоритмов сглаживания и фильтрации, а также появилась поддержка эффекта HDR. С этим самым HDR NVIDIA наступила на грабли, так как на всех картах GeForce седьмой серии он не мог работать одновременно с активированным режимом полноэкранного сглаживания и пользователю приходилось выбирать лишь одно из двух. В то время, как Radeon X1800 и Х1900 прекрасно работали и с тем и с другим одновременно. Помимо аппаратной несовместимости HDR и антиалайзинга у G70 были проблемы с использованием анизотропной фильтрации: вдали многие текстуры сильно теряли в детализации и появлялся эффект замыливания. Несмотря на недостатки, видеокарты имели определенный успех на рынке. Осенью была выпущена ускоренная версия GeForce 7800 GTX с расширенным до 512 Мб объёмом видеопамяти и сильно поднятыми тактовыми частотами, а весной, менее чем через год после релиза, был произведен "рестайлинг" G70, в результате чего появился обновленный G71. Новый-старый чип выпускался с использованием более тонкого 90-нм технологического процесса, что благотворно сказалось на тактовых частотах. Новым флагманом стала GeForce 7900 GTX, одновременно с ней вышла и более дешевая GeForce 7900 GT с уменьшенным до 256 Мб объемом видеопамяти и более скромными тактовыми частотами, но при этом сохранившая все функциональные блоки графического процессора. Тогда же был представлен новый король среднего ценового сегмента - GeForce 7600GT, камня на камне не оставивший от Radeon X1600 и первая эталонная двухчиповая карта NVIDIA - GeForce 7900 GX2, предназначавшаяся исключительно для продажи в составе готовых высокопроизводительных компьютеров от партнёров компании. До потребительского сегмента она дошла несколько позже в виде несколько упрощенной GeForce 7950 GX2. Видеокарты седьмой серии были последними продуктами NVIDIA, которые выпускались в вариантах с поддержкой шины AGP, самыми быстрыми навсегда остались Gainward Bliss 7800 GS+ Silent и GeForce 7950 GT AGP.

Выходу восьмого поколения GeForce предшествовала мощная рекламная компания, а по сети гуляло множество различных слухов: кто-то обсуждал фотографии видеокарты с гибридной системой охлаждения, другие спорили о предназначении загадочного чипа NVIO, третьи строили безумные теории насчет поддержки физических эффектов, а четвертых волновало энергопотребление, стоимость и немалые размеры печатной платы. С официальным релизом, который состоялся 8 ноября 2006 года (да, меньше чем через год карте стукнет десять лет) были получены и ответы на некоторые вопросы:

- эталонная версия видеокарты не предусматривала использование гибридной системы охлаждения и обходилась стандартным кулером с центробежным вентилятором. Однако позже гибридный вариант, замеченный на прототипе, был выпущен компанией Cooler Master в виде самостоятельного продукта Hydra 8800. Вероятно на этапе проектирования рассматривалась возможность оснащения карты подобным охладителем.

- чип NVIO отвечал за работу внешних интерфейсов, таких как DVI и HDTV-Out. Также в нем находился цифрово-аналоговый преобразователь RAMDAC

- расчеты физических эффектов GeForce 8800 GTX изначально не поддерживала, а не стандартная шина доступа к памяти объяснялась тем, что такое значение инженеры посчитали оптимальным с точки зрения цены и обеспечиваемой пропускной способностью. Поддержка расчетов физики появилась значительно позже, вместе с поглощением компании Ageia, которая до этого занималась разработкой и поддержкой собственного программного движка PhysX.

- несмотря на опасения, видеокарта обходилась без специального внешнего блока питания, а таинственный разъем на задней панели оказался ничем иным как обыкновенным HDTV-Out. Размеры адаптера и вправду впечатляли, карта достигала 27 сантиметров в длину и была, пожалуй, одной из самых длинных потребительских видеокарт на то время. В этом плане поспорить с ней могла разве что GeForce 7900 GX2, да Mac версия GeForce 6800 Ultra. Что касается тепловыделения - чип G80 оказался не столь уж и горячим, а инженеры с достоинством выполнили поставленную задачу и спроектировали довольно тихую систему охлаждения, которая эффективно отводила излишки тепла за пределы корпуса и удерживала температуру графического процессора на отметке в 70-75*С.

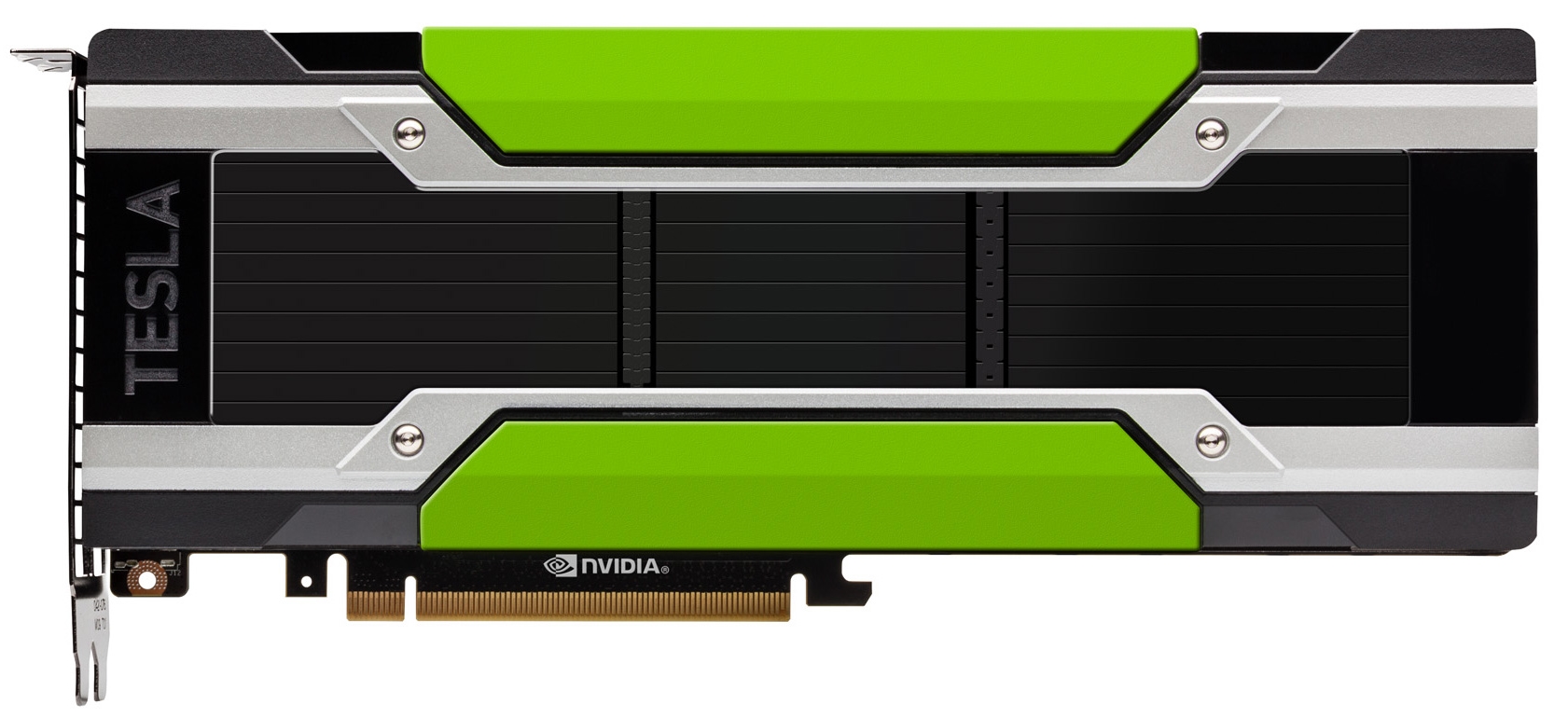

Что же нового привнесла восьмая серия? А принесла она унифицированную шейдерную архитектуру, которая объединяла пиксельные и вершинные процессоры в единые блоки. Всего таких блоков было 8, каждый из них содержал 16 ALU (арифме́тико-логи́ческих устро́йств), 4 блока текстурирования (TMU) и собственный кэш первого уровня, в котором могли храниться не только текстуры, но и другие данные, которые мог запросить шейдерный процессор. Всего, таким образом, имелось 128 потоковых процессоров (ALU) и 32 текстурных блока + 24 блока растеризации, сами потоковые процессоры функционировали на удвоенной частоте графического чипа. Архитектура получилась очень гибкой и способной плавно масштабироваться. Видеокарта поддерживала новейший DirectX 10 и Shader Model 4.0. Была наконец-то реализована совместная работа полноэкранного сглаживания и HDR, проведены оптимизации работы анизотропной фильтрации, качество картинки стало, как минимум, не хуже, чем у конкурента, а также был добавлен новый алгоритм сглаживания CSAA (Coverage Sampling AA). Что касается производительности - GeForce 8800 GTX не оставлял ни единого шанса видеокартам прошлых поколений. Побиты были не только одиночные флагманы, но и тандем 7950 GX2 с Crossfire связкой из пары X1950 XTX. Средний ценовой сегмент выступал не так уверенно. Новый GeForce 8600 GTS ничего не мог противопоставить подешевевшим GeForce 7950GT и Radeon X1950 GT/Pro и при бОльшей стоимости зачастую сильно проигрывал им. Помимо старшей модели 8800 GTX на основе видеочипа G80 выпускалась более бюджетная версия - GeForce 8800 GTS 640, в ней было отключено два блока ALU, а ширина шины памяти была уменьшена до 320 бит. Архитектура Tesla, представителем которой была GeForce 8800 GTX оказалась долгожительницей. Уже весной 2007 года была анонсирована GeForce 8800 Ultra, которая представляла из себя слегка разогнанный вариант 8800 GTX с немного измененной системой охлаждения, новой ревизией видеочипа G80-A3 и более быстрой 0,8 нс видеопамятью. Осенью 2007 года была представлена усовершенствованная версия видеочипа G80 - G92, которая выпускалась по более тонкому 65-нм технологическому процессу. В новом чипе упростили разводку, сделав шину доступа к памяти 256-битной, удвоили количество текстурных блоков, а также добавили поддержку шины PCI-E 2.0, но уменьшили до 16 количество блоков растеризации. Первой на его основе выпустили GeForce 8800GT, которая предлагала графический чип G92 в варианте с 7-ю активными блоками ALU из 8, что давало ей в итоге 112 потоковых процессоров, 56 текстурных блоков и 16 блоков растеризации. Столь выдающиеся характеристики в сочетании с высокими тактовыми частотами приближали производительность карты вплотную к уровню обычной 8800 GTX. Цена при этом была значительно ниже, чем у бывшего флагмана, что сделало GeForce 8800GT бестселлером. Зимой вышла обновленная GeForce 8800 GTS, основанная на всё том же G92, но со всеми 8-ю активными блоками ALU. Эта карта фактически заменила собой снятую с производства 8800 GTX. Графический чип G92, а также выпускавшийся по более тонкому 55-нм технологическому процессу G92b, продолжил своё победное шествие и в 2008 году. На нём были основаны все старшие модели семейства GeForce 9. От предшественников они отличались лишь парочкой незначительных архитектурных улучшений, двумя SLI коннекторами, поддержкой технологии Hybrid Power и более высокими тактовыми частотами. Девятая серия наконец-то предложила по настоящему крепкого представителя среднего ценового сегмента - GeForce 9600GT с 256 бит шиной памяти и 64 универсальными процессорами. Подобных характеристик в своё время ждали от 8600 GT, но последняя не оправдала возложенных на неё надежд. Апофеозом же стал выпуск двухчиповой видеокарты GeForce 9800 GX2, основанной на паре чипов G92b.

реклама

Дальнейшее развитие архитектуры Tesla было представлено 17 июня 2009 года в лице флагманского GeForce GTX280 и более доступного GTX260. Порядок именования графических процессоров в очередной раз был изменен в каких-то непонятных, известных лишь богу маркетинга, целях - старший видеочип нарекли GT200. Выпускался он по проверенному 65-нм технологическому процессу. Количество универсальных шейдерных процессоров увеличилось почти в два раза - до 240, текстурных блоков до 80, а блоков растеризации с 16 до 32. Видеокарты обладали стандартным набором поддерживаемых технологий: DirectX 10, SLI, PhysX, HybridPower, добавился новый интерфейс DisplayPort, поддерживавший разрешения вплоть до 2560 х 1600 с использованием 10-битного цветового пространства. Серьёзной переработке подверглась сама вычислительная архитектура, доработки были прежде всего направлены на оптимизацию работы карты в не игровых приложениях с использованием технологии CUDA (Compute Unified Device Architecture), универсальные потоковые процессоры были переименованы в CUDA ядра. GeForce GTX280/285 были первыми и единственными продуктами компании NVIDIA, в которых была реализована 512-бит шина доступа к памяти. Внесённые изменения самым негативным образом сказались на площади видеочипа, которая равнялась 576 мм², что на тот момент делало его самым большим чипом из когда-либо выпускавшихся Тайваньской фабрикой TSMC. Даже сегодня GT200 занимает в этом сомнительном рейтинге почётное второе место, уступая лишь более новому Maxwell GM200 (GeForce TitanX и 980Ti). GeForce GTX280 получился очень быстрым и с лёгкостью обходил своего предшественника, часто оставляя позади и двухчиповой GeForce 9800 GX2. Однако за скорость приходилось заплатить высоким тепловыделением и немалой стоимостью самой карты, которая составляла $649. Агрессивная ценовая политика AMD с её Radeon HD 4870, предлагавшейся за $299 и нацеленной на борьбу с GTX260 в среднем ценовом сегменте, вынудило компанию NVIDIA поспешно выпустить обновленную версию GeForce GTX260 Core 216 с увеличенным количеством CUDA ядер, а так же постепенно перевести свой монструозный GT200 на более тонкий 55-нм технологический процесс. Это дало возможность освежить существующий модельный ряд и уменьшить себестоимость производства с отпускными ценами. Уменьшенное энергопотребление и тепловыделение тоже внесли свой вклад и позволили наконец-то выпустить двухчиповую GeForce GTX295, как ответ на ранее вышедший Radeon HD 4870x2.

Позже была представлена новая архитектура - Fermi и два поколения видеокарт на его основе: GTX400 и обновленная GTX500, которые привнесли поддержку нового DirectX 11 и успешно боролись с продукцией AMD вплоть до выхода архитектуры Kepler. Было это всё относительно недавно, поэтому я не стану заострять ваше внимание на описании этих событий, после краткого экскурса в историю можно перейти непосредственно к тому, ради чего все это затевалось.

NVIDIA  FX 5500 Dual. Как и в случае с Radeon 8500 MAXX, данная видеокарта была плодом воображения одного из пользователей зарубежных форумов и даже несмотря на очевидное вмешательство Photoshop'а, новость о грядущем выходе данной видеокарты имела некоторое распространение.

FX 5500 Dual. Как и в случае с Radeon 8500 MAXX, данная видеокарта была плодом воображения одного из пользователей зарубежных форумов и даже несмотря на очевидное вмешательство Photoshop'а, новость о грядущем выходе данной видеокарты имела некоторое распространение.

Jaton  6200 Dual была сугубо профессиональным решением, предназначенным не для заядлых игроманов, а для профессионалов, которым требовался вывод изображения на четыре экрана мониторов одновременно. Видеоадаптер был выполнен на нестандартной печатной плате зеленого цвета и имел в своем распоряжении пару видеочипов NV43, суммарный объем видеопамяти стандарта DDR2 равнялся 1024 Мб. За дополнительное питание отвечал одиночный 6-pin разъем. Особенностью видеоадаптера была возможность его применения в связке с любой материнской платой благодаря устаревшему, но универсальному PCI разъему. Так уж вышло, что на сегодняшний день эта видеокарта является самой младшей многочиповой картой, основанной на видеочипах производства компании Nvidia.

6200 Dual была сугубо профессиональным решением, предназначенным не для заядлых игроманов, а для профессионалов, которым требовался вывод изображения на четыре экрана мониторов одновременно. Видеоадаптер был выполнен на нестандартной печатной плате зеленого цвета и имел в своем распоряжении пару видеочипов NV43, суммарный объем видеопамяти стандарта DDR2 равнялся 1024 Мб. За дополнительное питание отвечал одиночный 6-pin разъем. Особенностью видеоадаптера была возможность его применения в связке с любой материнской платой благодаря устаревшему, но универсальному PCI разъему. Так уж вышло, что на сегодняшний день эта видеокарта является самой младшей многочиповой картой, основанной на видеочипах производства компании Nvidia.

Помимо длинной версии карты существовала и укороченная, основанная на совершенно другой печатной плате с массивным радиатором. К слову, эта плата позже практически без изменений была использована и в Jaton GeForce 8400 GS Dual.

ASUS  6600GT Dual. Компания ASUS представила свое видение двухчиповой 6600GT в рамках международной выставки CeBIT 2005. Согласно информации представленной на официальном слайде, предполагалось, что видеокарта станет первым в мире графическим решением с двумя видеочипами, которое будет поддерживать вывод изображения одновременно на 4 монитора. Этому способствовала пара разъемов DVI, располагавшихся на задней панели видеокарты и специальные разъемы в верхней части печатной платы, к которым подключалась двойка дополнительных VGA разъемов, аналогично таким у серийной ASUS GeForce 7800GT Dual (в ранних новостях об ASUS 6600GT Dual ошибочно предполагалось, что эти разъемы предназначались для объединения пары видеоадаптеров в режим Quad SLI). Помимо дуэта видеочипов NV43 на плате располагалось восемь чипов памяти Samsung с маркировкой K4J55323QF-GC16 и временем выборки 1,6 нс, суммарным объемом 256 Мб. Питание видеокарты осуществлялось посредством одного 6-pin PCI-E разъема дополнительного питания. В серию видеокарта не пошла, ссылка на оригинальную новость.

6600GT Dual. Компания ASUS представила свое видение двухчиповой 6600GT в рамках международной выставки CeBIT 2005. Согласно информации представленной на официальном слайде, предполагалось, что видеокарта станет первым в мире графическим решением с двумя видеочипами, которое будет поддерживать вывод изображения одновременно на 4 монитора. Этому способствовала пара разъемов DVI, располагавшихся на задней панели видеокарты и специальные разъемы в верхней части печатной платы, к которым подключалась двойка дополнительных VGA разъемов, аналогично таким у серийной ASUS GeForce 7800GT Dual (в ранних новостях об ASUS 6600GT Dual ошибочно предполагалось, что эти разъемы предназначались для объединения пары видеоадаптеров в режим Quad SLI). Помимо дуэта видеочипов NV43 на плате располагалось восемь чипов памяти Samsung с маркировкой K4J55323QF-GC16 и временем выборки 1,6 нс, суммарным объемом 256 Мб. Питание видеокарты осуществлялось посредством одного 6-pin PCI-E разъема дополнительного питания. В серию видеокарта не пошла, ссылка на оригинальную новость.

Gigabyte 3D1  6600GT Dual. Gigabyte была первой компанией, которая представила двухчиповую GeForce 6600GT. Особенностью видеокарты было то, что на старте продаж она была совместима лишь с одной единственной моделью материнской платы - Gigabyte GA-K8NXP-SLI и продавалась с ней в комплекте в огромной коробке, размерам которой позавидуют многие современные продукты серии Republic of Gamers от ASUS. Примечательно, что даже несмотря на такое серьезное ограничение в плане совместимости, видеокарта стала серийным продуктом и добралась до прилавков магазинов. Видеокарта была построена на основе пары видеочипов NV43, каждый из которых обладал собственными 128 Мб видеопамяти стандарта GDDR3 с маркировкой K4J55323QF-GC16 и временем выборки 1,6 нс, таким образом суммарный объем видеопамяти составлял 256 Мб. Производитель немного поднял тактовые частоты видеокарты: частота памяти составляла 570 МГц против стандартных 500 МГц, частоты же ядер составляли стандартные заводские 500 МГц. При рекомендованной стоимости комплекта в $500-550 видеокарта явно была нацелена на конкуренцию с одиночной GeForce 6800GT, но из-за сырости драйверов и уникальности самой видеокарты, борьба происходила с переменным успехом, особенно в высоких разрешениях с использованием полноэкранного сглаживания, где негативно сказывался малый объем установленной видеопамяти. Пожалуй следует отметить факт того, что спустя некоторое время Gigabyte выпустила специальный SLI переключатель, который позволял видеокарте функционировать в паре с любой материнской платой основанной на чипсете nForce 4 SLI, и делал ее более универсальным решением, чем ранее. Обзор и тестирование видеокарты GeForce 6600 GT Dual можно посмотреть тут.

6600GT Dual. Gigabyte была первой компанией, которая представила двухчиповую GeForce 6600GT. Особенностью видеокарты было то, что на старте продаж она была совместима лишь с одной единственной моделью материнской платы - Gigabyte GA-K8NXP-SLI и продавалась с ней в комплекте в огромной коробке, размерам которой позавидуют многие современные продукты серии Republic of Gamers от ASUS. Примечательно, что даже несмотря на такое серьезное ограничение в плане совместимости, видеокарта стала серийным продуктом и добралась до прилавков магазинов. Видеокарта была построена на основе пары видеочипов NV43, каждый из которых обладал собственными 128 Мб видеопамяти стандарта GDDR3 с маркировкой K4J55323QF-GC16 и временем выборки 1,6 нс, таким образом суммарный объем видеопамяти составлял 256 Мб. Производитель немного поднял тактовые частоты видеокарты: частота памяти составляла 570 МГц против стандартных 500 МГц, частоты же ядер составляли стандартные заводские 500 МГц. При рекомендованной стоимости комплекта в $500-550 видеокарта явно была нацелена на конкуренцию с одиночной GeForce 6800GT, но из-за сырости драйверов и уникальности самой видеокарты, борьба происходила с переменным успехом, особенно в высоких разрешениях с использованием полноэкранного сглаживания, где негативно сказывался малый объем установленной видеопамяти. Пожалуй следует отметить факт того, что спустя некоторое время Gigabyte выпустила специальный SLI переключатель, который позволял видеокарте функционировать в паре с любой материнской платой основанной на чипсете nForce 4 SLI, и делал ее более универсальным решением, чем ранее. Обзор и тестирование видеокарты GeForce 6600 GT Dual можно посмотреть тут.

Gigabyte 3D1 XL  6600 Dual. Сразу же вслед за двухчиповой 3D1 GeForce 6600GT Dual, Gigabyte анонсировали похожую плату, но основанную на видеочипах GeForce 6600, которые характеризовались более низкими тактовыми частотами. Новая видеокарта мало чем отличалась от своего старшего собрата, в глаза бросалась лишь слегка измененная конструкция системы охлаждения: размер радиатора полностью повторял таковой у Gigabyte 3D1 6600GT Dual, но место пары вентиляторов занял один, располагавшийся в центре радиатора. Печатная же плата не претерпела совершенно никаких изменений, более того, инженеры Gigabyte не поскупились и снабдили свою 3D1 XL видеопамятью стандарта GDDR3, вместо положенной для простой GeForce 6600 памяти стандарта DDR и не постеснялись поднять частоты видеочипа с 300 до 450 МГц, таким образом подобная карта могла практически на равных соперничать со SLI связкой из пары одиночных GeForce 6600GT. Так же как и старшая модель, Gigabyte 3D1 XL 6600 Dual продавалась только в комплекте с совместимой материнской платой, в роли которой выступала Gigabyte GA-K8N Ultra-SLI. При рекомендованной стоимости в $400 видеокарта могла стать довольно интересной альтернативой одиночной GeForce 6800GT, особенно если учесть, что в ее цену входила достаточно неплохая материнская плата. Ссылка на оригинальную новость.

6600 Dual. Сразу же вслед за двухчиповой 3D1 GeForce 6600GT Dual, Gigabyte анонсировали похожую плату, но основанную на видеочипах GeForce 6600, которые характеризовались более низкими тактовыми частотами. Новая видеокарта мало чем отличалась от своего старшего собрата, в глаза бросалась лишь слегка измененная конструкция системы охлаждения: размер радиатора полностью повторял таковой у Gigabyte 3D1 6600GT Dual, но место пары вентиляторов занял один, располагавшийся в центре радиатора. Печатная же плата не претерпела совершенно никаких изменений, более того, инженеры Gigabyte не поскупились и снабдили свою 3D1 XL видеопамятью стандарта GDDR3, вместо положенной для простой GeForce 6600 памяти стандарта DDR и не постеснялись поднять частоты видеочипа с 300 до 450 МГц, таким образом подобная карта могла практически на равных соперничать со SLI связкой из пары одиночных GeForce 6600GT. Так же как и старшая модель, Gigabyte 3D1 XL 6600 Dual продавалась только в комплекте с совместимой материнской платой, в роли которой выступала Gigabyte GA-K8N Ultra-SLI. При рекомендованной стоимости в $400 видеокарта могла стать довольно интересной альтернативой одиночной GeForce 6800GT, особенно если учесть, что в ее цену входила достаточно неплохая материнская плата. Ссылка на оригинальную новость.

Leadtek  PX6600GT Duo TDH Extreme. Видеокарта Leadtek Duo PX6600GT впервые предстала перед объективами фотокамер в рамках международной выставки CeBIT 2005, а в серию должна была пойти вскоре после проведения выставки Computex 2005. Продукт Leadtek выгодно отличался от своего единственного конкурента в лице Gigabyte 3D1 тем, что не требовал для работы специальной материнской платы, достаточным условием было лишь наличие чипсета nForce 4 SLI. Видеокарта была построена на базе пары видеочипов NV43 которые функционировали на частоте 525 МГц (на 25 МГц выше, чем у Gigabyte 3D1), каждый GPU обладал своими собственными 128-ю мегабайтами видеопамяти стандарта GDDR3, которая функционировала на частоте 1120 МГц, таким образом общий объем видеопамяти составлял 256 Мб. Питание подавалось посредством одного 6-pin PCI-E разъема дополнительного питания, а за вывод изображения отвечала пара разъемов DVI и пара внешних разъемов VGA, которые подключались к видеокарте через специальный коннектор. Рекомендованная стоимость видеокарты составляла $400, обзор и тестирование детища Leadtek можно посмотреть тут.

PX6600GT Duo TDH Extreme. Видеокарта Leadtek Duo PX6600GT впервые предстала перед объективами фотокамер в рамках международной выставки CeBIT 2005, а в серию должна была пойти вскоре после проведения выставки Computex 2005. Продукт Leadtek выгодно отличался от своего единственного конкурента в лице Gigabyte 3D1 тем, что не требовал для работы специальной материнской платы, достаточным условием было лишь наличие чипсета nForce 4 SLI. Видеокарта была построена на базе пары видеочипов NV43 которые функционировали на частоте 525 МГц (на 25 МГц выше, чем у Gigabyte 3D1), каждый GPU обладал своими собственными 128-ю мегабайтами видеопамяти стандарта GDDR3, которая функционировала на частоте 1120 МГц, таким образом общий объем видеопамяти составлял 256 Мб. Питание подавалось посредством одного 6-pin PCI-E разъема дополнительного питания, а за вывод изображения отвечала пара разъемов DVI и пара внешних разъемов VGA, которые подключались к видеокарте через специальный коннектор. Рекомендованная стоимость видеокарты составляла $400, обзор и тестирование детища Leadtek можно посмотреть тут.

MSI  Geminium Go 6600. Странная и по-своему уникальная "видеокарта" MSI Geminium Go 6600 была впервые представлена на выставке CES 2006. По сути дела, изделие MSI являлось PCI Express x16 адаптером для настольного компьютера, который позволял задействовать в режиме SLI два мобильных графических модуля формата MXM, которые находили применение в ноутбуках с дискретной графикой. В представленном на CES экземпляре использовалась пара модулей GeForce Go 6600, каждый модуль располагал собственными 256 Мб видеопамяти и функционировал на частотах 300 МГц для ядра и 600 МГц для видеопамяти. В серию видеокарта не пошла, но в сети имеется обзор видеокарты, который можно посмотреть, пройдя по ссылке.

Geminium Go 6600. Странная и по-своему уникальная "видеокарта" MSI Geminium Go 6600 была впервые представлена на выставке CES 2006. По сути дела, изделие MSI являлось PCI Express x16 адаптером для настольного компьютера, который позволял задействовать в режиме SLI два мобильных графических модуля формата MXM, которые находили применение в ноутбуках с дискретной графикой. В представленном на CES экземпляре использовалась пара модулей GeForce Go 6600, каждый модуль располагал собственными 256 Мб видеопамяти и функционировал на частотах 300 МГц для ядра и 600 МГц для видеопамяти. В серию видеокарта не пошла, но в сети имеется обзор видеокарты, который можно посмотреть, пройдя по ссылке.

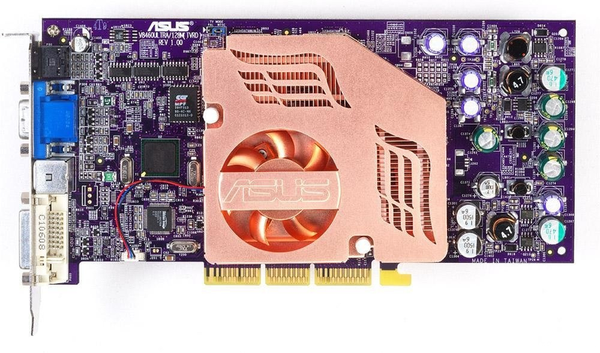

ASUS  6800 GT Dual. Компания ASUS представила свой двухчиповой прототип, использовавший пару видеочипов NV45, еще в рамках зимней выставки CeBIT 2005, правда в то время предполагался выпуск не GeForce 6800 GT Dual, а GeForce 6800 Ultra Dual. Примечательно, что в ASUS планировали выпускать свою видеокарту с частотами даже бОльшими, нежели те, которыми располагала одиночная GeForce 6800 Ultra: 430 МГц для видеочипов и 1120 МГц для памяти, против заводских 400/1100 МГц, которыми характеризовался одночиповой флагман. Уже к моменту проведения выставки Computex 2005 видеокарта приобрела статус рабочего образца, однако в серию разогнанная Ultra версия не пошла. Причин может быть много: возможно крест на выходе столь амбиционного продукта поставил выход нового одночипового флагмана в лице GeForce 7800GTX и компания решила не создавать ей внутреннего конкурента, а может быть дело было в недостаточном количестве годных видеочипов, способных работать на столь высоких тактовых частотах. Как бы то ни было, в серию пошла менее амбициозная GT версия ускорителя. Видеоадаптер имел в своем распоряжении пару видеочипов NV45, которые функционировали на частоте 350 МГц, частоты видеопамяти стандарта GDDR3, суммарный объем которой составлял 512 Мб, а время выборки 1,6 нс, составляли 500 МГц. Дополнительное питание подавалось посредством пары 6-pin PCI-E разъемов, а за вывод изображения отвечало два DVI разъема. Отдельно стоит отметить, что изначально видеокарта была совместима далеко не со всеми моделями материнских плат и со временем ASUS (как и Gigabyte в случае своей 3D1 6600GT) представила специальный SLI переключатель. Предполагалось, что он позволит использовать видеокарту в паре с ранее несовместимыми материнскими платами. Обзор и тестирование ASUS GeForce 6800GT Dual можно посмотреть тут и тут.

6800 GT Dual. Компания ASUS представила свой двухчиповой прототип, использовавший пару видеочипов NV45, еще в рамках зимней выставки CeBIT 2005, правда в то время предполагался выпуск не GeForce 6800 GT Dual, а GeForce 6800 Ultra Dual. Примечательно, что в ASUS планировали выпускать свою видеокарту с частотами даже бОльшими, нежели те, которыми располагала одиночная GeForce 6800 Ultra: 430 МГц для видеочипов и 1120 МГц для памяти, против заводских 400/1100 МГц, которыми характеризовался одночиповой флагман. Уже к моменту проведения выставки Computex 2005 видеокарта приобрела статус рабочего образца, однако в серию разогнанная Ultra версия не пошла. Причин может быть много: возможно крест на выходе столь амбиционного продукта поставил выход нового одночипового флагмана в лице GeForce 7800GTX и компания решила не создавать ей внутреннего конкурента, а может быть дело было в недостаточном количестве годных видеочипов, способных работать на столь высоких тактовых частотах. Как бы то ни было, в серию пошла менее амбициозная GT версия ускорителя. Видеоадаптер имел в своем распоряжении пару видеочипов NV45, которые функционировали на частоте 350 МГц, частоты видеопамяти стандарта GDDR3, суммарный объем которой составлял 512 Мб, а время выборки 1,6 нс, составляли 500 МГц. Дополнительное питание подавалось посредством пары 6-pin PCI-E разъемов, а за вывод изображения отвечало два DVI разъема. Отдельно стоит отметить, что изначально видеокарта была совместима далеко не со всеми моделями материнских плат и со временем ASUS (как и Gigabyte в случае своей 3D1 6600GT) представила специальный SLI переключатель. Предполагалось, что он позволит использовать видеокарту в паре с ранее несовместимыми материнскими платами. Обзор и тестирование ASUS GeForce 6800GT Dual можно посмотреть тут и тут.

Gigabyte 3D1  6800GT Dual. Видеокарта 3D1 Geforce 6800GT Dual была предст авлена компанией Gigabyte в рамках выставки Computex 2005. Инженеры компании изначально проектировали именно GT версию, в отличии от ASUS и MSI, которые намеривались выпустить монстроподобную двухчиповую GeForce 6800 Ultra, но в итоге потерпели фиаско, в первом случае ограничившись выпуском более скромной GT версии, а во втором и вовсе отказавшись от серийного производства. В итоге видеоадаптер производства Gigabyte получился достаточно интересным: в отличии от творения ASUS видеокарта оказалась достаточно компактной, шутка ли, длина авианосца USS ASUS составляла ошеломительные по тем временам 300 мм, в то время как Gigabyte довольствовался более скромными 260 мм, во многом благодаря тому, что инженеры компании не поленились расположить 512 Мб видеопамяти стандарта GDDR3 по обеим сторонам печатной платы. Правда "короткая" печатная плата слегка омрачалась массивной системой охлаждения, высота которой составляла аж 50 мм. Видеокарта изначально была выпущена с фабрично повышенными частотами: 370 МГц для видеочипов и 1060 МГц для памяти, против эталонных 350/1000МГц. В отличии от все тех же ASUS и MSI, адаптер располагал лишь одним разъемом дополнительного питания, который, возможно, сыграл с ним злую шутку: ведь видеокарта обладала весьма скромным разгонным потенциалом. Gigabyte 3D1 GeForce 6800GT Dual была лишена многих детских болезней, которые были свойственны ранним младшим картам серии 3D1, основанным на видеочипах NV43, так, для работы изначально не требовалась специфическая материнская плата, хотя необходимость наличия у материнской платы поддержки технологии NVIDIA SLI никто не отменял. Обзор и тестирование видеокарты Gigabyte 3D1 GeForce 6800GT Dual можно посмотреть, пройдя по ссылке.

6800GT Dual. Видеокарта 3D1 Geforce 6800GT Dual была предст авлена компанией Gigabyte в рамках выставки Computex 2005. Инженеры компании изначально проектировали именно GT версию, в отличии от ASUS и MSI, которые намеривались выпустить монстроподобную двухчиповую GeForce 6800 Ultra, но в итоге потерпели фиаско, в первом случае ограничившись выпуском более скромной GT версии, а во втором и вовсе отказавшись от серийного производства. В итоге видеоадаптер производства Gigabyte получился достаточно интересным: в отличии от творения ASUS видеокарта оказалась достаточно компактной, шутка ли, длина авианосца USS ASUS составляла ошеломительные по тем временам 300 мм, в то время как Gigabyte довольствовался более скромными 260 мм, во многом благодаря тому, что инженеры компании не поленились расположить 512 Мб видеопамяти стандарта GDDR3 по обеим сторонам печатной платы. Правда "короткая" печатная плата слегка омрачалась массивной системой охлаждения, высота которой составляла аж 50 мм. Видеокарта изначально была выпущена с фабрично повышенными частотами: 370 МГц для видеочипов и 1060 МГц для памяти, против эталонных 350/1000МГц. В отличии от все тех же ASUS и MSI, адаптер располагал лишь одним разъемом дополнительного питания, который, возможно, сыграл с ним злую шутку: ведь видеокарта обладала весьма скромным разгонным потенциалом. Gigabyte 3D1 GeForce 6800GT Dual была лишена многих детских болезней, которые были свойственны ранним младшим картам серии 3D1, основанным на видеочипах NV43, так, для работы изначально не требовалась специфическая материнская плата, хотя необходимость наличия у материнской платы поддержки технологии NVIDIA SLI никто не отменял. Обзор и тестирование видеокарты Gigabyte 3D1 GeForce 6800GT Dual можно посмотреть, пройдя по ссылке.

MSI  6800 Ultra Dual. Компания MSI тоже решила не отсиживаться в стороне и, вслед за ASUS и Gigabyte, представила на выставке Computex 2005 свою версию двухчиповой видеокарты, построенной на основе пары видеочипов NV45. Инженеры MSI решили не мелочиться и снабдили свою видеокарту сразу 1 Гб видеопамяти стандарта GDDR3, более того, в верхней части ускорителя находился разъем SLI, который потенциально позволял организовать беспрецедентно быструю по тем временам Quad SLI конфигурацию, обладавшую невероятным суммарным объемом видеопамяти в 2 Гб! В конструкции системы охлаждения использовалось шесть тепловых трубок, а сама система охлаждения была разнесена по обеим сторонам печатной платы, дополнительное питание подавалось посредством пары 6-pin PCI-E разъемов питания. Отдельно стоит отметить факт того, что инженеры MSI, в отличии от своих коллег из ASUS, умудрились уместить пару NV45 на печатной плате более или менее вменяемого размера, что положительным образом сказалось бы на совместимости адаптера с различными моделями корпусов системных блоков. К несчастью, скорый выход GeForce 7800GTX не дал амбициозным планам MSI сбыться и в серию видеокарта не пошла.

6800 Ultra Dual. Компания MSI тоже решила не отсиживаться в стороне и, вслед за ASUS и Gigabyte, представила на выставке Computex 2005 свою версию двухчиповой видеокарты, построенной на основе пары видеочипов NV45. Инженеры MSI решили не мелочиться и снабдили свою видеокарту сразу 1 Гб видеопамяти стандарта GDDR3, более того, в верхней части ускорителя находился разъем SLI, который потенциально позволял организовать беспрецедентно быструю по тем временам Quad SLI конфигурацию, обладавшую невероятным суммарным объемом видеопамяти в 2 Гб! В конструкции системы охлаждения использовалось шесть тепловых трубок, а сама система охлаждения была разнесена по обеим сторонам печатной платы, дополнительное питание подавалось посредством пары 6-pin PCI-E разъемов питания. Отдельно стоит отметить факт того, что инженеры MSI, в отличии от своих коллег из ASUS, умудрились уместить пару NV45 на печатной плате более или менее вменяемого размера, что положительным образом сказалось бы на совместимости адаптера с различными моделями корпусов системных блоков. К несчастью, скорый выход GeForce 7800GTX не дал амбициозным планам MSI сбыться и в серию видеокарта не пошла.

MSI  Geminium Go 7600. Творение сумрачных немецких тайваньских гениев компании MSI повторно предстало перед публикой в рамках выставки Computex 2006. Инженеры время даром не теряли: печатная плата "видеокарты" была подвергнута серьезной доработке: MXM модули теперь располагались по обеим сторонам платы, что положительным образом сказалось на ее размерах. Место пары модулей, основанных на видеочипах NV43M (GeForce Go 6600) заняли новые, основанные на G73 (GeForce Go 7600). Концепция самой "видеокарты" не изменилась: она по прежнему представляла из себя своеобразный PCI Express х16 адаптер для настольного компьютера, который позволял задействовать в режиме SLI два мобильных графических модуля формата MXM. Отдельно отмечу, что на стенде MSI демонстрировалась и версия оборудованная лишь пассивной системой охлаждения. Обзор и тестирование MSI Geforce Geminium Go 7600 можно посмотреть тут.

Geminium Go 7600. Творение сумрачных немецких тайваньских гениев компании MSI повторно предстало перед публикой в рамках выставки Computex 2006. Инженеры время даром не теряли: печатная плата "видеокарты" была подвергнута серьезной доработке: MXM модули теперь располагались по обеим сторонам платы, что положительным образом сказалось на ее размерах. Место пары модулей, основанных на видеочипах NV43M (GeForce Go 6600) заняли новые, основанные на G73 (GeForce Go 7600). Концепция самой "видеокарты" не изменилась: она по прежнему представляла из себя своеобразный PCI Express х16 адаптер для настольного компьютера, который позволял задействовать в режиме SLI два мобильных графических модуля формата MXM. Отдельно отмечу, что на стенде MSI демонстрировалась и версия оборудованная лишь пассивной системой охлаждения. Обзор и тестирование MSI Geforce Geminium Go 7600 можно посмотреть тут.

Galaxy  7600GT Dual Masterpiece. Компания Galaxy официально анонсировала графический адаптер Galaxy Masterpiece Dual 7600 GT в рамках выставки Computex 2006. Необычность видеокарты (ровно как и ее старшего собрата в лице Galaxy 7900 GT Dual) заключалась в том, что производитель разместил на одной PCB сразу два графических процессора NVIDIA GeForce 7600GT. На каждый из GPU приходилось по 256 Мб 1,2 нс видеопамяти стандарта GDDR3 со 128-битным интерфейсом, что, правда, не мешало маркетологам Galaxy гордо заявлять о 256 битной шине. Видеочипы G73 функционировали на частоте 560 МГц, а видеопамять на частоте 1400 МГц, дополнительное питание подавалось посредством одного 6-pin PCI-E разъема. Рекомендованную цену предполагалось установить на отметке в 450 евро, но в итоге в серию видеокарта Galaxy Masterpiece Dual 7600 GT не пошла, более подробные фотографии печатной платы можно посмотреть, пройдя по ссылке.

7600GT Dual Masterpiece. Компания Galaxy официально анонсировала графический адаптер Galaxy Masterpiece Dual 7600 GT в рамках выставки Computex 2006. Необычность видеокарты (ровно как и ее старшего собрата в лице Galaxy 7900 GT Dual) заключалась в том, что производитель разместил на одной PCB сразу два графических процессора NVIDIA GeForce 7600GT. На каждый из GPU приходилось по 256 Мб 1,2 нс видеопамяти стандарта GDDR3 со 128-битным интерфейсом, что, правда, не мешало маркетологам Galaxy гордо заявлять о 256 битной шине. Видеочипы G73 функционировали на частоте 560 МГц, а видеопамять на частоте 1400 МГц, дополнительное питание подавалось посредством одного 6-pin PCI-E разъема. Рекомендованную цену предполагалось установить на отметке в 450 евро, но в итоге в серию видеокарта Galaxy Masterpiece Dual 7600 GT не пошла, более подробные фотографии печатной платы можно посмотреть, пройдя по ссылке.

ASUS  7800GT Dual. Видеокарта ASUS GeForce 7800GT Dual была впервые представлена далекой осенью 2005 года, вскоре после летнего анонса 7-го поколения видеокарт NVIDIA. Компания решила не затягивать с выпуском своего монстра (как в случае с GeForce 6800GT Dual) и вскоре после анонса появились его первые обзоры. Сердцем видеокарты служила пара видеочипов G70, выполненных по 110 нм техпроцессу, в распоряжении каждого из которых имелось 256 Мб видеопамяти стандарта GDDR3. Стоит отметить, что несмотря на использование видеопроцессоров характерных для GeForce 7800GT, их частоты были установлены на уровне GTX версии: 430 МГц для ядра и 1200 МГц для памяти соответственно. Из-за высокого по тем временам потребления электроэнергии, видеокарта поставлялась в комплекте со специальным внешним блоком питания, коннектор которого прятался под верхним ребром жесткости.

7800GT Dual. Видеокарта ASUS GeForce 7800GT Dual была впервые представлена далекой осенью 2005 года, вскоре после летнего анонса 7-го поколения видеокарт NVIDIA. Компания решила не затягивать с выпуском своего монстра (как в случае с GeForce 6800GT Dual) и вскоре после анонса появились его первые обзоры. Сердцем видеокарты служила пара видеочипов G70, выполненных по 110 нм техпроцессу, в распоряжении каждого из которых имелось 256 Мб видеопамяти стандарта GDDR3. Стоит отметить, что несмотря на использование видеопроцессоров характерных для GeForce 7800GT, их частоты были установлены на уровне GTX версии: 430 МГц для ядра и 1200 МГц для памяти соответственно. Из-за высокого по тем временам потребления электроэнергии, видеокарта поставлялась в комплекте со специальным внешним блоком питания, коннектор которого прятался под верхним ребром жесткости.

В этот раз инженерам ASUS удалось уместить свой тандем в рамках куда более скромной, 250 мм печатной платы (камень в огород GeForce 6800GT Dual с ее 310 мм длины). Интересной особенностью видеокарты было и то, что несмотря на отсутствие разъемов MIO, у пользователей все же была возможность объединить мощь пары видеокарт в режиме Quad SLI. Все, что для этого требовалось - это материнская плата с парой PCI-E х16 слотов, да драйвер ForceWare 77.77 из комплекта поставки видеокарты. Видеокарта была выпущена ограниченным тиражом в 2000 экземпляров. Обзор и тестирование ASUS GeForce 7800GT Dual можно посмотреть тут и тут.

Galaxy  7900GT Dual Masterpiece впервые предстала перед объективами фотокамер в рамках выставки Computex 2006. В отличии от инженеров NVIDIA, их коллеги из Galaxy ухитрились разместить пару полноценных видеочипов G71 в рамках одной печатной платы. Помимо пары GPU, видеокарта была оборудована 1 Гб видеопамяти стандарта GDDR3. Обращает на себя внимание и факт того, что частоты видеокарты существенно отличались от таковых у одиночной GeForce 7900GT: частота ядра составляла 607 Мгц, а памяти, которая характеризовалась временем выборки 1,2 нс - 1520 Мгц, против стандартных 450/1320 МГц, характерных для одночипового собрата и 500/1200 МГц, для референсной GeForce 7950 GX2. Продукт от Galaxy превосходил эталонную плату от NVIDIA по всем параметрам, даже рекомендованная цена была ниже - $599 против $600. Но помимо множества плюсов у Galaxy GeForce 7900GT Dual были и минусы: видеокарта была совместима только с материнскими платами, основанными на чипсете NVIDIA nForce 4 SLI, также у видеокарты отсутствовал разъем MIO, что сразу же перечеркивало возможность сборки Quad SLI конфигурации, в итоге недостатки перевесили достоинства и в серию видеокарта не пошла. Но, к счастью, один из рабочих предсерийных образцов попал в руки журналистов сайта Guru3D, и благодаря этому у нас есть возможность посмотреть обзор и тестирование этой, без сомнения, интересной видеокарты.

7900GT Dual Masterpiece впервые предстала перед объективами фотокамер в рамках выставки Computex 2006. В отличии от инженеров NVIDIA, их коллеги из Galaxy ухитрились разместить пару полноценных видеочипов G71 в рамках одной печатной платы. Помимо пары GPU, видеокарта была оборудована 1 Гб видеопамяти стандарта GDDR3. Обращает на себя внимание и факт того, что частоты видеокарты существенно отличались от таковых у одиночной GeForce 7900GT: частота ядра составляла 607 Мгц, а памяти, которая характеризовалась временем выборки 1,2 нс - 1520 Мгц, против стандартных 450/1320 МГц, характерных для одночипового собрата и 500/1200 МГц, для референсной GeForce 7950 GX2. Продукт от Galaxy превосходил эталонную плату от NVIDIA по всем параметрам, даже рекомендованная цена была ниже - $599 против $600. Но помимо множества плюсов у Galaxy GeForce 7900GT Dual были и минусы: видеокарта была совместима только с материнскими платами, основанными на чипсете NVIDIA nForce 4 SLI, также у видеокарты отсутствовал разъем MIO, что сразу же перечеркивало возможность сборки Quad SLI конфигурации, в итоге недостатки перевесили достоинства и в серию видеокарта не пошла. Но, к счастью, один из рабочих предсерийных образцов попал в руки журналистов сайта Guru3D, и благодаря этому у нас есть возможность посмотреть обзор и тестирование этой, без сомнения, интересной видеокарты.

NVIDIA  7900 GX2 Впервые видеокарта GeForce 7900 GX2 была представлена компанией Foxconn на выставке CeBIT 2006. Видеоадаптер предназначался к использованию только в составе готовых систем производства компаний DELL и Hewlett Packard. К примеру, пара таких карт устанавливалась в систему Dell XPS 600 Renegade стоимостью в $10000, а компания Alienware в своей системе Alienware Aurora ALX пошла еще дальше, снабдив GeForce 7900 GX2 водоблоками и установив ценник на отметке в $14800. Видеокарты GeForce 7900 GX2 никогда не выпускались отдельно от готовых систем, хотя некоторые производители шли на хитрость, продавая карты в составе Barebone систем, которые помимо парочки 7900 GX2, включали блок питания Tagan мощностью 900 Вт, материнскую плату Asus A8N32-SLI Deluxe и корпус Akasa, все это безобразие предлагалось по цене от $2200 до $2500. Видеокарта GeForce 7900 GX2 была построена на базе пары видеопроцессоров GeForce G71, которые функционировали на частоте 500 МГц (против 650 МГц у одиночной 7900 GTX). Каждый GPU располагал 512-ю мегабайтами видеопамяти стандарта GDDR3, которая функционировала на частоте 1200 МГц и сообщался с ней посредством 256 битной шины памяти. Видеокарта была оборудована SLI разъемом для объединения пары адаптеров в режим Quad SLI. Обзор системы, построенной на базе пары GeForce 7900 GX2, можно посмотреть тут и тут.

7900 GX2 Впервые видеокарта GeForce 7900 GX2 была представлена компанией Foxconn на выставке CeBIT 2006. Видеоадаптер предназначался к использованию только в составе готовых систем производства компаний DELL и Hewlett Packard. К примеру, пара таких карт устанавливалась в систему Dell XPS 600 Renegade стоимостью в $10000, а компания Alienware в своей системе Alienware Aurora ALX пошла еще дальше, снабдив GeForce 7900 GX2 водоблоками и установив ценник на отметке в $14800. Видеокарты GeForce 7900 GX2 никогда не выпускались отдельно от готовых систем, хотя некоторые производители шли на хитрость, продавая карты в составе Barebone систем, которые помимо парочки 7900 GX2, включали блок питания Tagan мощностью 900 Вт, материнскую плату Asus A8N32-SLI Deluxe и корпус Akasa, все это безобразие предлагалось по цене от $2200 до $2500. Видеокарта GeForce 7900 GX2 была построена на базе пары видеопроцессоров GeForce G71, которые функционировали на частоте 500 МГц (против 650 МГц у одиночной 7900 GTX). Каждый GPU располагал 512-ю мегабайтами видеопамяти стандарта GDDR3, которая функционировала на частоте 1200 МГц и сообщался с ней посредством 256 битной шины памяти. Видеокарта была оборудована SLI разъемом для объединения пары адаптеров в режим Quad SLI. Обзор системы, построенной на базе пары GeForce 7900 GX2, можно посмотреть тут и тут.

NVIDIA  7950 GX2 Двухчиповой GeForce 7950 GX2 предназначенный, в отличие от вышеупомянутой 7900 GX2, для продажи "простым смертным", был представлен в рамках международной выставки Computex 2006, рекомендованная цена на момент анонса составляла $600. Так же как и 7900 GX2 видеокарта была построена на базе пары видеочипов G71, выполненных по 65 нм техпроцессу, каждый видеочип обладал собственными 512-ю мегабайтами видеопамяти стандарта GDDR3, а частоты ядра и памяти не отличались от таковых у GeForce 7900 GX2. Инженеры NVIDIA проделали большую работу, уместив всю мощь 7900 GX2 в более короткой и дешевой 7950 GX2. Так же как и ее предшественница, карта несла на себе SLI разъем, позволявший объединять пару видеоадаптеров в режим Quad SLI при наличии соответствующей материнской платы. Все выпущенные видеокарты были построены на основе эталонного дизайна, разработанного инженерами NVIDIA, правда среди них встречались и экземпляры с повышенными на заводе частотами, к примеру XFX серии XXX, разогнанная производителем до 570 МГц по ядру.

7950 GX2 Двухчиповой GeForce 7950 GX2 предназначенный, в отличие от вышеупомянутой 7900 GX2, для продажи "простым смертным", был представлен в рамках международной выставки Computex 2006, рекомендованная цена на момент анонса составляла $600. Так же как и 7900 GX2 видеокарта была построена на базе пары видеочипов G71, выполненных по 65 нм техпроцессу, каждый видеочип обладал собственными 512-ю мегабайтами видеопамяти стандарта GDDR3, а частоты ядра и памяти не отличались от таковых у GeForce 7900 GX2. Инженеры NVIDIA проделали большую работу, уместив всю мощь 7900 GX2 в более короткой и дешевой 7950 GX2. Так же как и ее предшественница, карта несла на себе SLI разъем, позволявший объединять пару видеоадаптеров в режим Quad SLI при наличии соответствующей материнской платы. Все выпущенные видеокарты были построены на основе эталонного дизайна, разработанного инженерами NVIDIA, правда среди них встречались и экземпляры с повышенными на заводе частотами, к примеру XFX серии XXX, разогнанная производителем до 570 МГц по ядру.

Единственной компанией (помимо Club3D, собственная версия которых так и осталась лишь в планах), которая хоть что-то сделала с эталонным дизайном карты, была американская EVGA, которая оснастила свою GeForce 7950 GX2 Black Pearl водоблоком и повысила ее частоты до 600 МГц по ядру и 1400 МГц по памяти. Обзор и тестирование видеокарты GeForce 7950 GX2 можно посмотреть тут, тут и тут.

Jaton  8400 GS Dual. Jaton GeForce 8400 GS Dual, как и Jaton 6200 Dual является гостем из профессионального сегмента. На короткой печатной плате зеленого цвета, которая практически полностью копировала укороченную версию Jaton GeForce 6200 Dual, располагалась пара видеочипов G86, каждый из которых мог похвастать 512 Мб видеопамяти стандарта DDR2, таким образом суммарный объем памяти равнялся 1024 Мб. Дополнительное питание видеокарте подавалось посредством одиночного 6-pin разъема, а сама она подключалась через разъем PCI. Помимо стандартной версии, компания Jaton выпускала и низкопрофильный вариант адаптера.

8400 GS Dual. Jaton GeForce 8400 GS Dual, как и Jaton 6200 Dual является гостем из профессионального сегмента. На короткой печатной плате зеленого цвета, которая практически полностью копировала укороченную версию Jaton GeForce 6200 Dual, располагалась пара видеочипов G86, каждый из которых мог похвастать 512 Мб видеопамяти стандарта DDR2, таким образом суммарный объем памяти равнялся 1024 Мб. Дополнительное питание видеокарте подавалось посредством одиночного 6-pin разъема, а сама она подключалась через разъем PCI. Помимо стандартной версии, компания Jaton выпускала и низкопрофильный вариант адаптера.

NVIDIA Quadro NVS 420. Профессиональная видеокарта Quadro NVS 420 располагала парой видеочипов G98 (GeForce 8400 GS A2) и 512 Мб видеопамяти стандарта GDDR3 и была предназначена для одновременного вывода изображения на несколько экранов мониторов. Для этого на задней панели видеоадаптера располагался специальный разъем VHDCI, который, посредством специального переходника, поддерживал работу до 4 дисплеев разрешением 1920 х 1080 одновременно (на сайте NVIDIA написано, что поддерживались дисплеи с разрешением до 2560 х 1600).

NVIDIA Quadro NVS 450. Подобно Quadro NVS 420, модель NVS 450 основывалась на всё тех же видеочипах G98 и выпускалась в варианте с 512 Мб видеопамяти стандарта GDDR3 (по 256 Мб на каждый графический чип). На задней панели размещалось четыре разъёма Display Port, которые обеспечивали поддержку до 4-хмониторов разрешением до 2560 х 1600 одновременно. От своего собрата карта отличалась более крупной печатной платой и полностью пассивной системой охлаждения.

Galaxy  8600GT Dual Masterpiece. Видеокарта представляла из себя прототип, выпущенный на скорую руку инженерами Galaxy и практически ничем не отличавшийся от их же более раннего творения - 7600GT Dual Masterpiece: та же плата, та же система охлаждения, то же расположение модулей памяти.

8600GT Dual Masterpiece. Видеокарта представляла из себя прототип, выпущенный на скорую руку инженерами Galaxy и практически ничем не отличавшийся от их же более раннего творения - 7600GT Dual Masterpiece: та же плата, та же система охлаждения, то же расположение модулей памяти.

Единственное отличие заключалось в использовании пары видеочипов G84 вместо G73.

NVIDIA  9800 GX2. Слухи о выходе видеокарты GeForce 9800 GX2 начали появляться еще в конце 2007 года. Постепенно в сети начала появляться информация, касающаяся нового флагмана, саму же видеокарту планировали представить на февральской выставке CeBIT 2008, но потом дату анонса перенесли на более позднее число и в итоге релиз состоялся только 18 марта 2008 года. Сама видеокарта задумывалась, как своеобразный ответ NVIDIA на выход Radeon HD 3870 Х2. Карту отличала необычная конструкция: инженеры NVIDIA не смогли уместить оба видеочипа на одной печатной плате, но при этом не использовали наработки более ранней GeForce 7900 GX2. Вместо того, чтобы, как раньше, разместить печатные платы друг над другом и снабдить каждый чип собственным кулером, инженеры повернули обе платы "лицом" друг к другу и разработали одну общую систему охлаждения, которая отвечала за отвод тепла сразу от обоих печатных плат. Как результат, графический ускоритель своим внешним видом стал напоминать эдакий черный кирпич.

9800 GX2. Слухи о выходе видеокарты GeForce 9800 GX2 начали появляться еще в конце 2007 года. Постепенно в сети начала появляться информация, касающаяся нового флагмана, саму же видеокарту планировали представить на февральской выставке CeBIT 2008, но потом дату анонса перенесли на более позднее число и в итоге релиз состоялся только 18 марта 2008 года. Сама видеокарта задумывалась, как своеобразный ответ NVIDIA на выход Radeon HD 3870 Х2. Карту отличала необычная конструкция: инженеры NVIDIA не смогли уместить оба видеочипа на одной печатной плате, но при этом не использовали наработки более ранней GeForce 7900 GX2. Вместо того, чтобы, как раньше, разместить печатные платы друг над другом и снабдить каждый чип собственным кулером, инженеры повернули обе платы "лицом" друг к другу и разработали одну общую систему охлаждения, которая отвечала за отвод тепла сразу от обоих печатных плат. Как результат, графический ускоритель своим внешним видом стал напоминать эдакий черный кирпич.

Адаптер имел в своей основе дуэт видеочипов G92, произведенных по 65 нм технологии, частоты видечипов были занижены до 600 МГц, чтобы вписать карту в установленный тепловой пакет. Общий объем установленной видеопамяти стандарта GDDR3 равнялся 1024 Мб, то есть на каждый отдельный видеочип приходилось 512 Мб собственной видеопамяти. Видеокарта вышла быстрой, сложной и очень горячей, не удивительно, что многие владельцы устанавливали на нее водяное охлаждение, а такие производители, как, например, EVGA, выпускали свою версию эталонного варианта GeForce 9800 GX2 с фабрично установленным водоблоком. К сожалению, инженеры NVIDIA снабдили видеокарту слишком малым количеством видеопамяти (то ли из соображений экономии, то ли в преддверии выхода 200й серии), поэтому в высоких разрешениях тот же GTX 280, который вышел через несколько месяцев после анонса 9800 GX2, смотрелся более уверенно и имел задел на будущее, которым 9800 GX2 не обладал. Обзор и тестирование NVIDIA GeForce 9800 GX2 можно посмотреть, пройдя по ссылке.