Возможно ли сделать автономные автомобили этичными и что это вообще значит

Беспилотные автомобили давно перестали быть научной фантастикой и разъезжают по городам многих стран мира. Однако, несмотря на это, пройдет еще несколько лет, прежде чем будущее с полностью беспилотным транспортом станет реальностью. По большей части, решения, которые должны принимать умные автомобили, довольно просты: остановиться на красный сигнал светофора, придерживаться своей полосы движения и делать все то, что сделал бы осторожный водитель. Но как быть в сложных или экстремальных ситуациях?

Image credits: Tom Hill.

Image credits: Tom Hill.

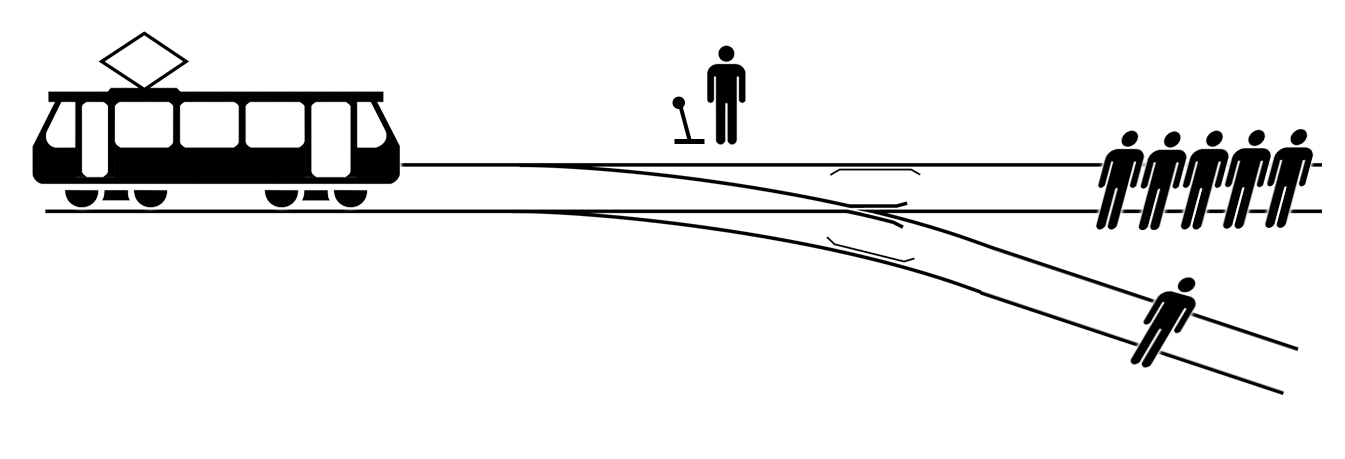

Возьмем хотя бы хорошо известную проблему с тележкой (троллейбусом). Допустим, едет пустой самодвижущийся автомобиль и вот-вот столкнется с несколькими пешеходами. Если он может свернуть на тротуар и никого не задеть, он, скорее всего, так и сделает. Но что, если на тротуаре тоже есть люди? Или что если он будет не пустым, и маневр подвергнет опасности его собственного пассажира? Как вообще будет выглядеть процесс принятия решения?

реклама

Зачастую моральные рамки автономных автомобилей рассматриваются как один из двух вариантов: либо эгоистичный (делать все возможное, чтобы защитить себя), либо утилитарный (делать то, что принесет наименьший совокупный ущерб). Но это не совсем корректно и не учитывает всех моральных тонкостей и дилемм, с которыми столкнутся автомобили.

Современные подходы к этике и автономным транспортным средствам являются очень упрощенными - моральные суждения гораздо сложнее", - говорит Велько Дубльевич, доцент программы "Наука, технологии и общество" (Science, Technology & Society -STS) в Университете штата Северная Каролина, США и автор статьи, в которой излагается эта проблема и возможные пути ее решения.

"Например, что если пять человек в машине - террористы? И что, если они намеренно используют преимущества алгоритма искусственного интеллекта, чтобы убить ближайшего пешехода или причинить вред другим людям? Тогда вы, вероятно, предпочтете, чтобы автономный автомобиль врезался в машину с этими пятью пассажирами. "Другими словами, упрощенный подход, который в настоящее время используется для решения этических вопросов в области искусственного интеллекта и автономных транспортных средств, не учитывает злого умысла. А его необходимо принимать во внимание".

Автономным автомобилям придется принимать множество сложных с этической точки зрения решений, напоминающих знаменитую проблемму с троллейбусом, которая изображена на рисунке.

Автономным автомобилям придется принимать множество сложных с этической точки зрения решений, напоминающих знаменитую проблемму с троллейбусом, которая изображена на рисунке.

реклама

Какова же альтернатива? Дублевич рекомендует использовать модель поведения агент-поступок (действие)-последствия (Agent-Deed-Consequence - ADC). Эта модель работает на основе трех основных вопросов для принятия решения относительно того или иного действия:

- Является ли намерение агента хорошим или плохим?

- Само действие хорошее или плохое?

- Является ли результат действия хорошим или плохим?

Модель ADC - это попытка объяснить моральные суждения, разбив их на положительные или отрицательные интуитивные оценки агента, поступка и последствий в любой ситуации. Это позволяет учитывать моральные сложности, с которыми не могут справиться остальные модели искусственного интеллекта.

Рассмотрим такую ситуацию: допустим, вы проехали перекресток на красный свет. Само действие плохое, но намерение может быть хорошим, если оно позволяет избежать столкновения - и если результат тоже будет положительным, то само действие будет хорошим. Использование этой концепции позволило бы получить больше возможностей для решения проблем "серой зоны", с которыми самоуправляемые автомобили, скорее всего, столкнутся в какой-то момент.

Безусловно, реализовать эту модель также довольно сложно. Например, такие моральные решения трудно принимать даже людям, и не существует универсальной схемы, позволяющей решить, является ли результат хорошим или нет. Вот именно поэтому задачи с тележками по-прежнему так популярны и широко обсуждаются в философии.

реклама

Дублевич считает, что модели ADC могут применяться в автономных автомобилях, но необходимо провести дополнительные исследования, чтобы убедиться, что они будут правильно реализованы и что этим преимуществом не воспользуются злоумышленники.

"Я руководил проведением эксперимента по изучению того, как философы и обычные люди подходят к моральным суждениям, и результаты были весьма любопытными. Если мы хотим подтвердить наши предварительные заключения и внедрить их в транспортные средства, необходимы дополнительные исследования моральных суждений человека, использующие более оперативные средства коммуникации, такие как виртуальная реальность. Кроме того, необходимо провести тщательное тестирование с помощью моделирования ситуаций на дороге, прежде чем какие-либо якобы "этичные" автомобили начнут регулярно делить дорогу с людьми. Теракты с использованием транспортных средств, к сожалению, стали довольно частым явлением, и мы должны быть уверены, что технологии беспилотных автомобилей не будут использованы в неблаговидных целях".

Источник: статья: Veljko Dubljeviс, "На пути к реализации модели ADC морального суждения в автономных транспортных средствах. Наука и инженерная этика".

Теги

Лента материалов

Соблюдение Правил конференции строго обязательно!

Флуд, флейм и оффтоп преследуются по всей строгости закона!

Комментарии, содержащие оскорбления, нецензурные выражения (в т.ч. замаскированный мат), экстремистские высказывания, рекламу и спам, удаляются независимо от содержимого, а к их авторам могут применяться меры вплоть до запрета написания комментариев и, в случае написания комментария через социальные сети, жалобы в администрацию данной сети.