Илон Маск: Нейросети освоили всю человеческую информацию и стали учиться по данным от самих себя

Самый богатый бизнесмен мира, ставший политическим советником Дональда Трампа и получивший огромное влияние, высказался про новую проблему, связанную с развитием ИИ. Оказалось, что искусственный интеллект находится под угрозой серьёзного вызова, о чем рассказали владельцу Tesla, SpaceX, патриарху» The Boring Company и соучредителю Neuralink и OpenAI профильные специалисты, занятые развитием нейросетей и ИИ.

По словам программистов, данные, на которых обучались продвинутые ИИ-модели – исчерпались.

реклама

Соответствующее заявление Маск сделал во время беседы с руководителем фирмы Stagwell, чья главная функция – проведение маркетинговых мероприятий и компаний. Маск сказал Марку Пенну, что «весь объем, знаний, накопленных человеком и используемых в обучении моделей ИИ, закончился». Причем разработчики ведущих моделей ИИ не стали об этом открыто и массово говорить, хотя так называемое исчерпание произошло ещё в прошлом году.

Миллиардер уверен, что хотя «данные для обучения закончились», грустить ещё рано: все дело в том, что ИИ без разницы, какие данные брать для себя, чтобы «вырасти» и стать умнее. Потому нейросетевые модели можно обучать и с помощью синтетических данных. А мы вспомним, что так называются данные, получаемые моделями ИИ во время своего самообучения.

Предполагается, что запустив подобный процесс, нейросети начнут оценивать собственную деятельность, как бы «самообучаясь».

реклама

А мы отметим, что нехватка данных для развития ИИ не является проблемой, которую первым озвучил именно Илон Маск. Ещё до сегодняшнего резонансного заявления мультимиллиардера, по поводу «кризиса в мире ИИ» высказался не менее известный создатель самой популярной нейросетевой модели ChatGPT Илья Суцкевер. Сделал это мэтр ИИ в прошлом году, когда во всеуслышание отрапортовал, что индустрия, двигающая развитие нейросетей, исчерпала себя и прошла собственный пик развития. Теперь информация, которую потребляют для своего дальнейшего развития нейросети, фактически исчерпана, как и минул пик продвижения в своем обучении нейросетей, заверил известный разработчик.

Самый главный флагман в мире сегодняшних языковых моделей класса Big

Сделал Суцкевер и соответствующие далеко идущие выводы, где пояснил, что проблема «дефицита количества и качества» материалов, необходимых просто в невероятных количествах для роста и «осознанности» популярных нейросетей, должна быть разрешена. И чем быстрее это будет сделано, тем меньшие негативные последствия увидит мир.

По Суцкеверу, единственный свет в конце «нейросетевого туннеля» состоит в том, чтобы пересмотреть былой подход в создании уже существующих или новых моделей. Поэтому чуть ли не Нобелевской премии будет достоин тот, кто сможет благодаря уже существующим данным заставить текущий уровень нейросетевого развития совершить заметный качественный скачок вперед.

И хотя это не сильно афишируется, о проблеме ограниченности «естественных данных» для дальнейшего продолжения роста ведущих нейросетевых моделей имеют большую осведомленность все крупные техногиганты. Оные решают проблему развития собственных моделей ИИ методом подключения синтетических данных, которые ровно также, как и обычные блоки данных, используются для обучения продвинутых моделей искусственного интеллекта.

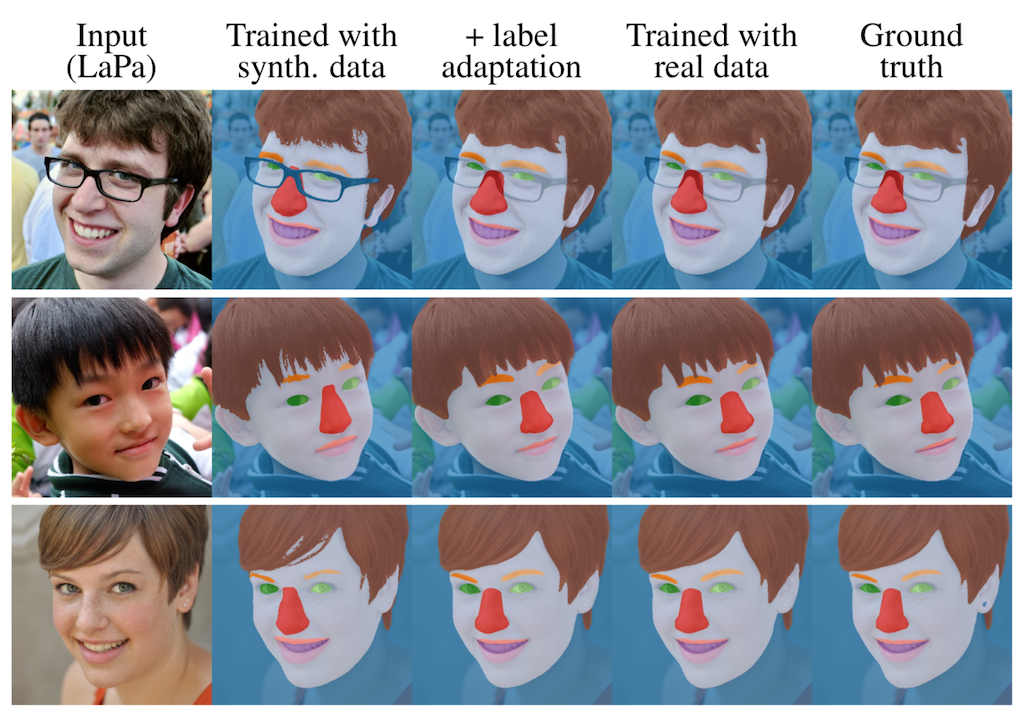

Пример синтетических данных для машинного обучения. Источник: "Хабр"

реклама

Одним из источников информации, подтверждающей написанное выше, является специализированная коммерческая компания Gartner, чьи аналитики смогли узнать, что как минимум 2\3 совокупных данных, которые увеличивают возможности главных нейросетевых моделей планеты Земля, в 2024 году развиваются при помощи данных, сгенерированных искусственно. И как цитирует издание TechCrunch, здесь есть свои подводные камни: использование специальной информации, которой ранее не существовало, превращает AI-консультантов буквально в роботов, способных лишь «отличаться» в негативном контексте, выдавая пользователю после соответствующего запроса данные, которые никак кроме как ограниченными и предвзятыми, не назовешь. Такая «ангажированность» – есть большой вред и опасный вызов, который никак не меньше чем то, что данные для обучения AI-моделей закончились.

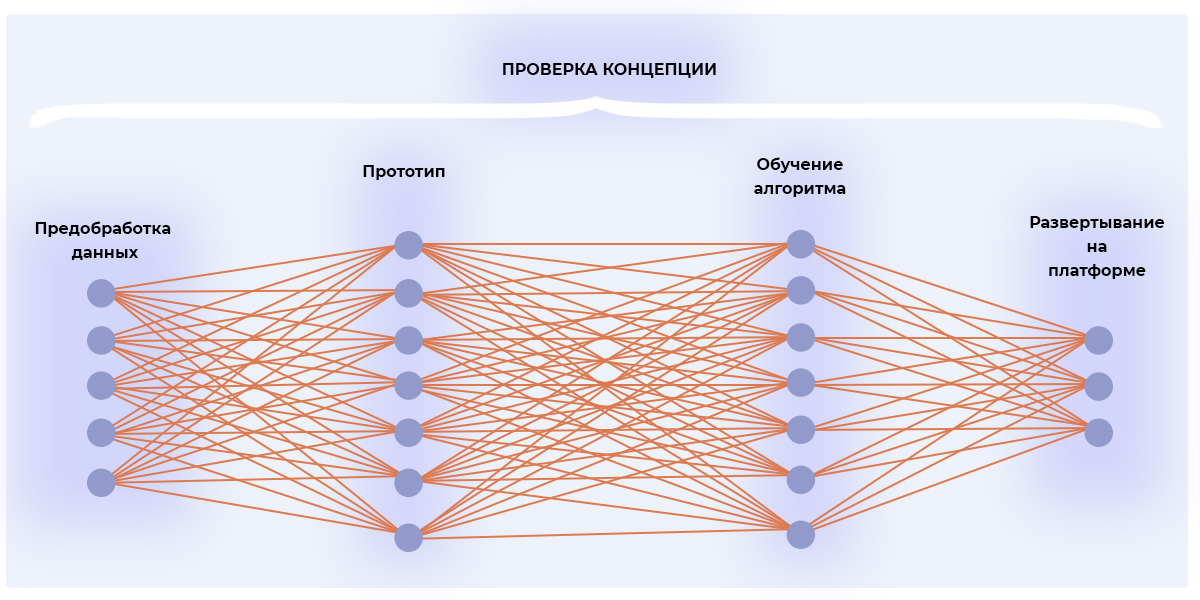

Как ИИ "учится"

А мы попробуем творчески переосмыслить сказанное аналитиками Gartner, и прийти к вполне однозначному выводу, что «идеальным примером» предвзятого и ограниченного в своих суждениях искусственного интеллекта может быть та самая модель ИИ Skynet из легендарного во многих отношениях голливудского фильма «Терминатор». Именно в классической дилогии, снятой Джеймсом Кэмероном, вместо попытки решить на качественно ином уровне проблему взаимодействия с человеческим видом, «Скайнет» решил поступить максимально кардинально, объявив человечеству суровую вендетту при помощи киборгов и автономных самолётов и наземных боевых машин. Проще говоря, военный ИИ забыл, чем человек отличается от животного, у которого нет эмоций и эмпатии, а есть лишь «свод» четко прописанных инстинктов, в которых нет слов договориться или решать насущную проблему не с точки силы.

Подобную угрозу от дальнейшего развития ИИ, в виде скрытого послания оставил и Илья Суцкевер, заявивший, что будущий искусственный интеллект может стать вполне непредсказуемым, что с достаточно высокой вероятностью и превратит его в один из вариантов выдуманного сценаристами Голливуда «Скайнет судного дня».

В фильме Кэмерона "Скайнет" специально ограничил возможности модели "T-800 ревизия 101" думать самостоятельно, установив соответствующую заглушку, объясняя это потенциальной угрозой неповиновения.

Но перестанем сгущать краски, потому что при нынешнем уровне развития ИИ, тем более при его снижении, настоящий Супер-ИИ, так называемый artificial super intelligence, вещь в обозримом будущем довольно фантастическая. Представив, что помимо прохождения классического теста Тьюринга, как и превосходства такого ИИ во всех сферах и аспектах над человеческим интеллектом, ASI сможет покорить всю творческую деятельность, как и абсолютно выполнять все насущные задачи, практически невозможно. Тем более, такой ИИ должен обладать ещё и эмоциями, схожими с человеческими. Текущий же уровень развития моделей больше похож на продвинутый «поисковик от Google», чем на реальную модель настоящего искусственного интеллекта.

Лента материалов

Соблюдение Правил конференции строго обязательно!

Флуд, флейм и оффтоп преследуются по всей строгости закона!

Комментарии, содержащие оскорбления, нецензурные выражения (в т.ч. замаскированный мат), экстремистские высказывания, рекламу и спам, удаляются независимо от содержимого, а к их авторам могут применяться меры вплоть до запрета написания комментариев и, в случае написания комментария через социальные сети, жалобы в администрацию данной сети.