Как драйвер NVIDIA вводит в заблуждение при создании пользовательских разрешений

Совсем недавно я делал обзор китайских переходников для VGA мониторов, даже разгон делал через панель управления NVIDIA создавая пользовательские разрешения:

Разборка, обзор и разгон китайских переходников HDMI/DP -> VGA

Но меня все время не покидало чувство, что изображение слишком низкого качества на выходе с переходниками, да и разгон удался слишком просто с одинаковой частотой на разных режимах...

реклама

А раньше я уже использовал ЭЛТ монитор LG Flatron F900B, тогда у меня была установлена видеокарта Radeon RX 560 с переходником HDMI-VGA и у меня в то время не было никаких претензий к качеству изображения и работы.

Слишком много нюансов вызывало подозрения, я начал ковырять драйвера NVIDIA и обнаружил много интересных "нюансов" которые покажу в данной статье.

NVIDIA часто любит вводить в заблуждение пользователей, древнейшая проблема с неполноценным RGB диапазоном чего стоит, "режим низкой задержки" тоже подкладывает неприятностей, а тут еще и с пользовательскими разрешениями неприятный нюанс всплыл...

реклама

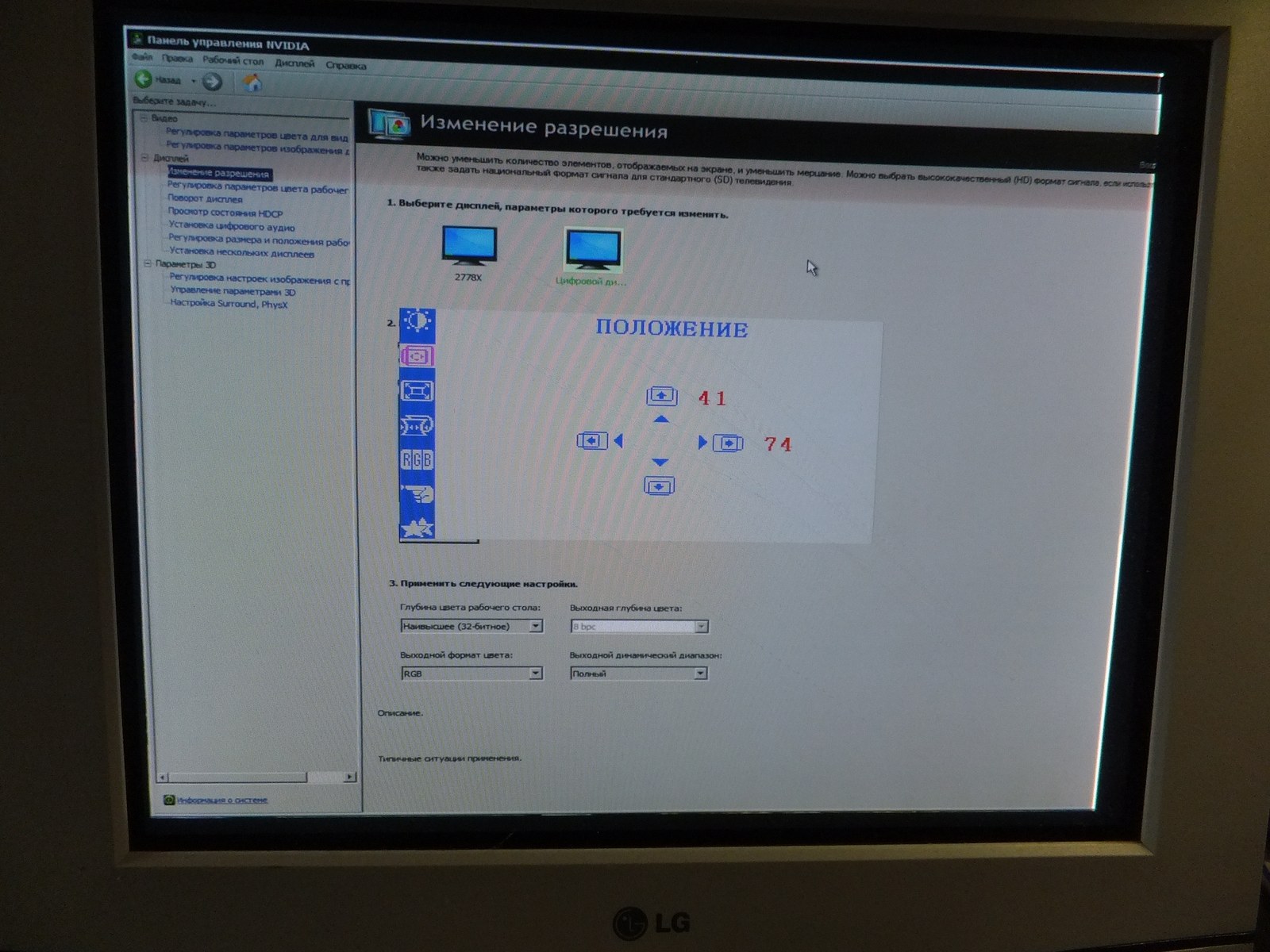

Первая проблема по вине NVIDIA это "съеденные" края изображения, и эту проблему никак нельзя было решить настройками монитора, а значит сигнал таким поступает на монитор.

|

|

Тут можно сказать что виноват переходник, но я точно помню что с видеокартой RX 560 такой проблемы не было с этим же HDMI-VGA переходником и этим же F900B монитором.

Второй подозрительный момент это "пиксели" на ЭЛТ мониторе, откуда они взялись через апертурную решетку ЭЛТ монитора? Это очень подозрительно было, но я продолжил писать обзор переходников не докапываясь сильно до этих странностей...

|

|

Докопался конкретно до этих странностей я позже, когда у меня появилось время и мне надоело смотреть на картинку которая явно хуже выглядит чем раньше с RX 560...

Масштабирование и "авто"

реклама

Казалось бы, причем тут масштабирование, но именно "масштабированием" NVIDIA и обманывает по сути пользователя при попытке создать пользовательское разрешение.

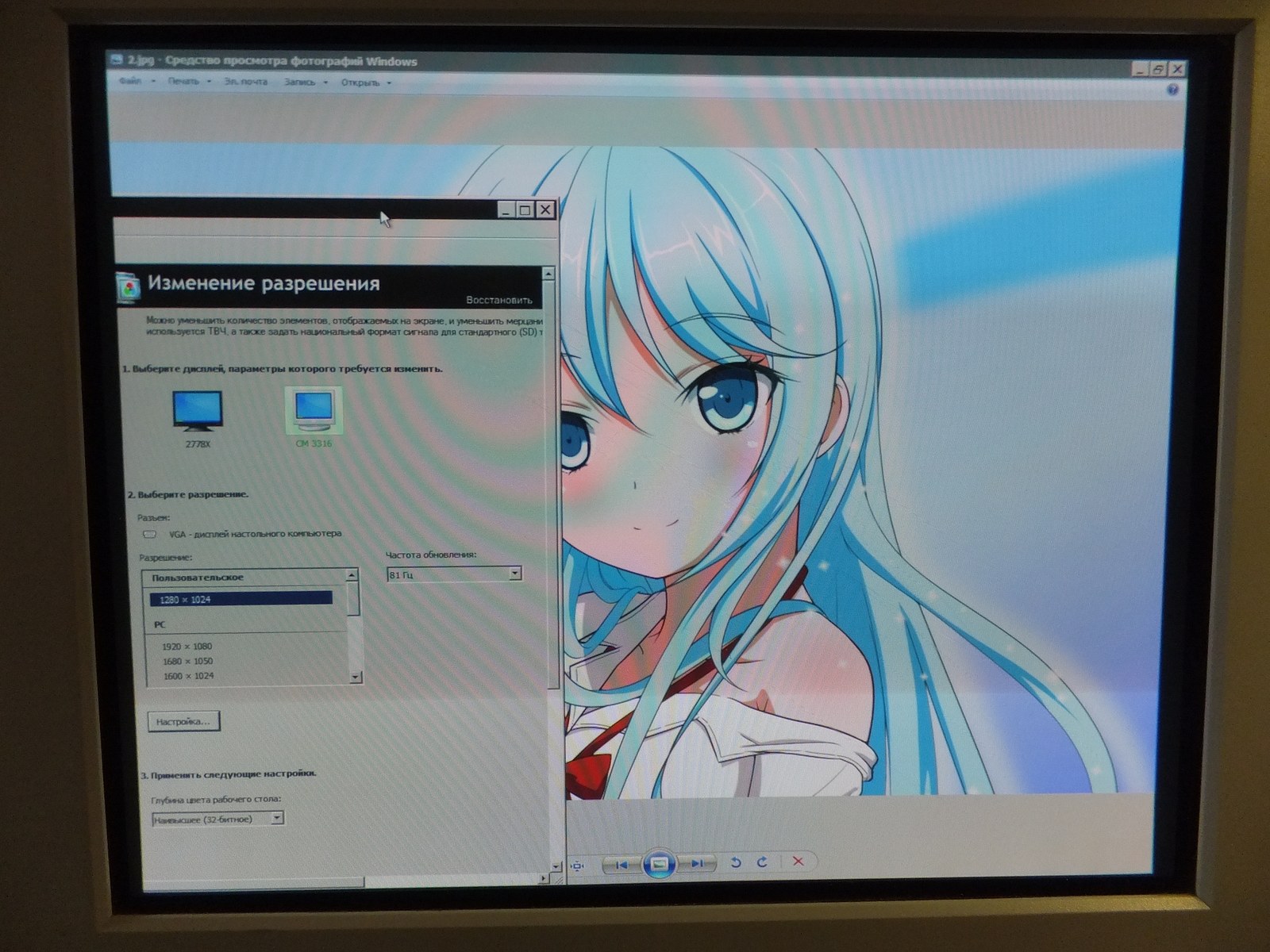

Обычно пользователь идет в меню пользовательских разрешений и создает желаемое разрешение оставляя синхронизацию на "авто" где параметры представлены в сером тоне не привлекая внимания:

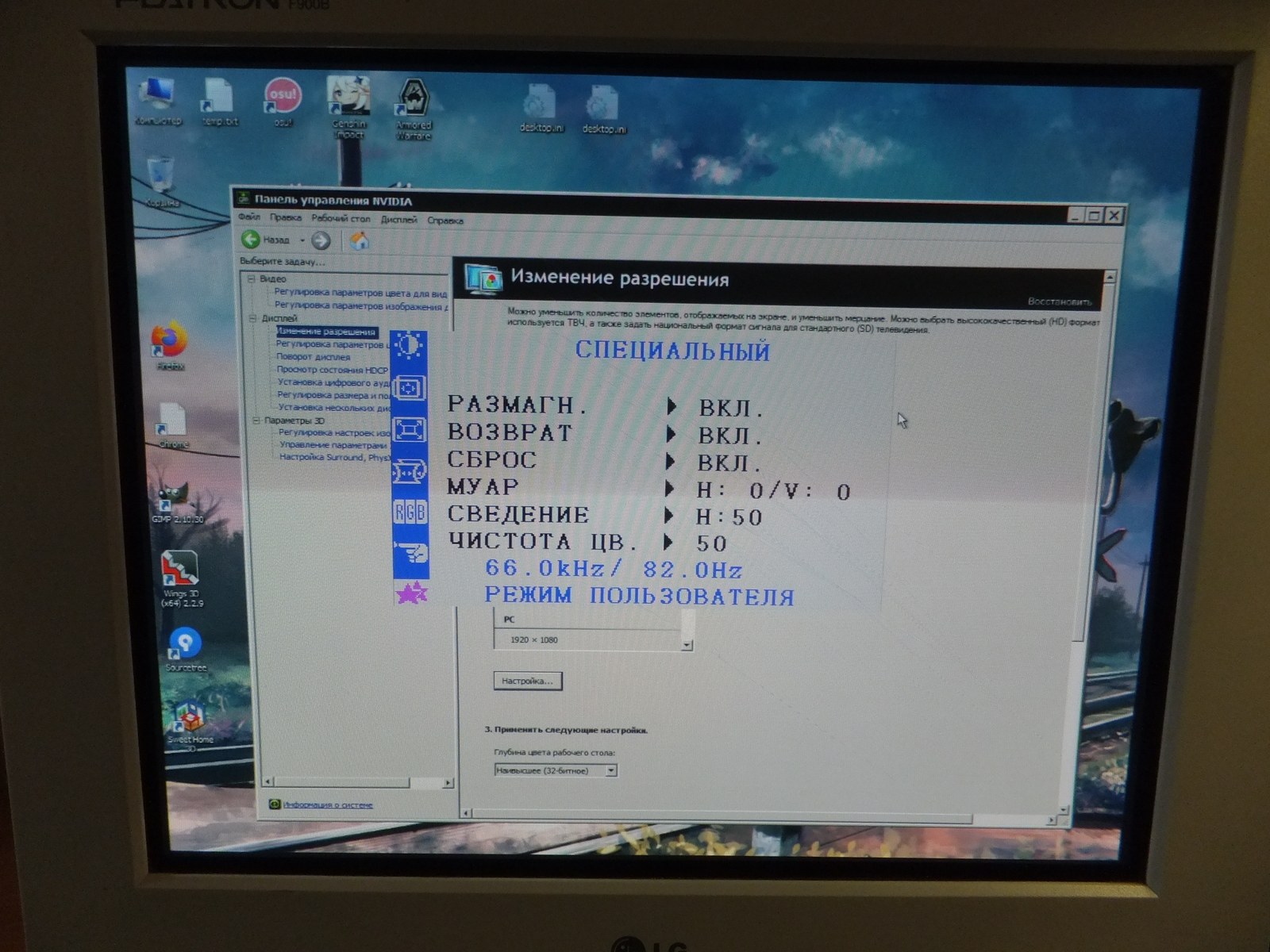

Все верно же, именно так ведь и создают пользовательские разрешения, даже монитор показывает частоту обновления правильно как в контрольной панели NVIDIA, но если посмотреть внимательно сразу заметна неестественная для ЭЛТ "пиксельность" явно скрадывающая шрифты.

Точно такая же скрадывающая "пиксельность" именно на ЖК мониторах отчетливо видна если установить разрешение неподходящее для ЖК матрицы.

|

|

реклама

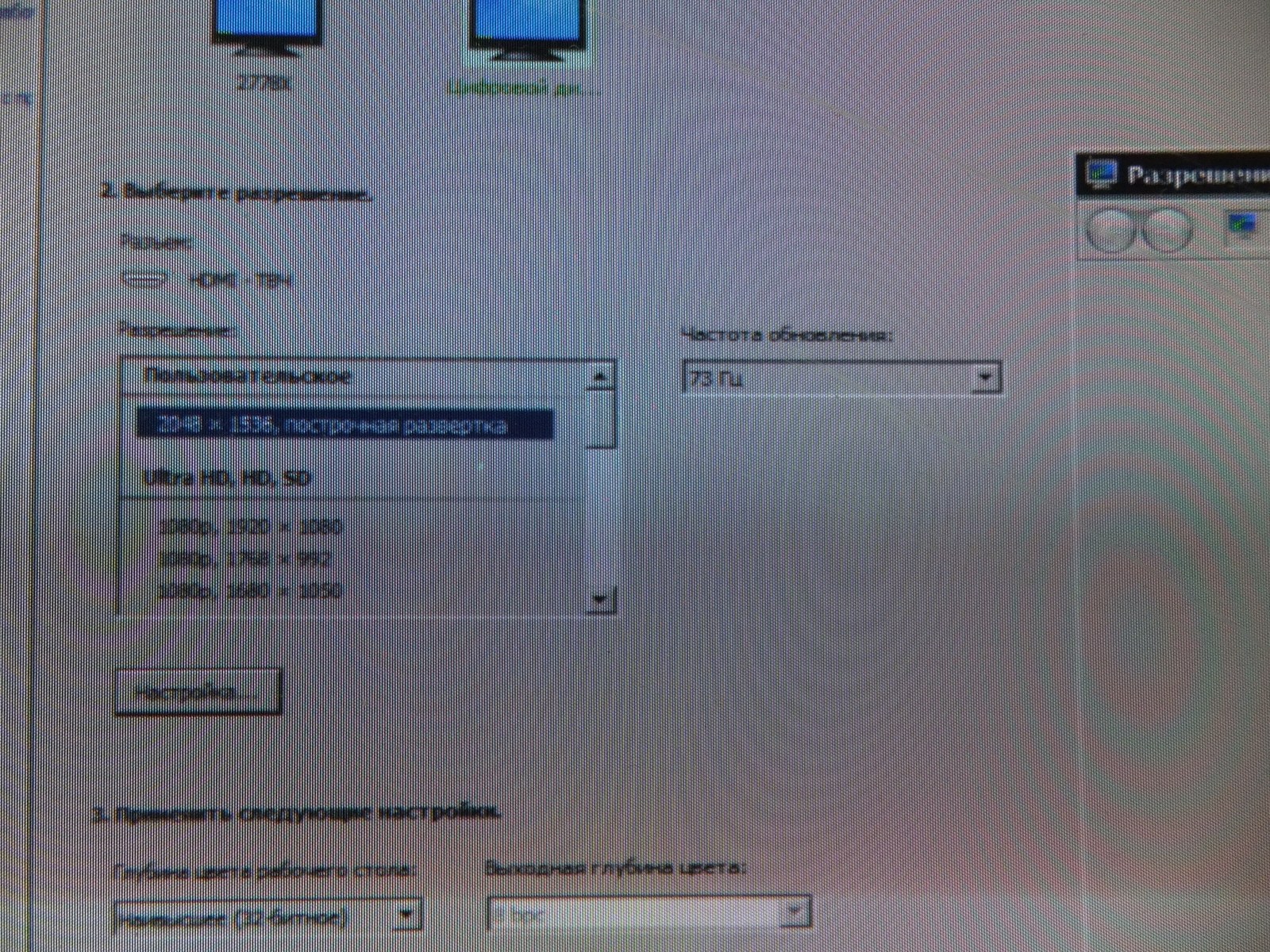

Я некоторое время ковырялся в настройках NVIDIA, и нашел причину плохого качества изображения и одинаковой частоты при разных разрешениях...

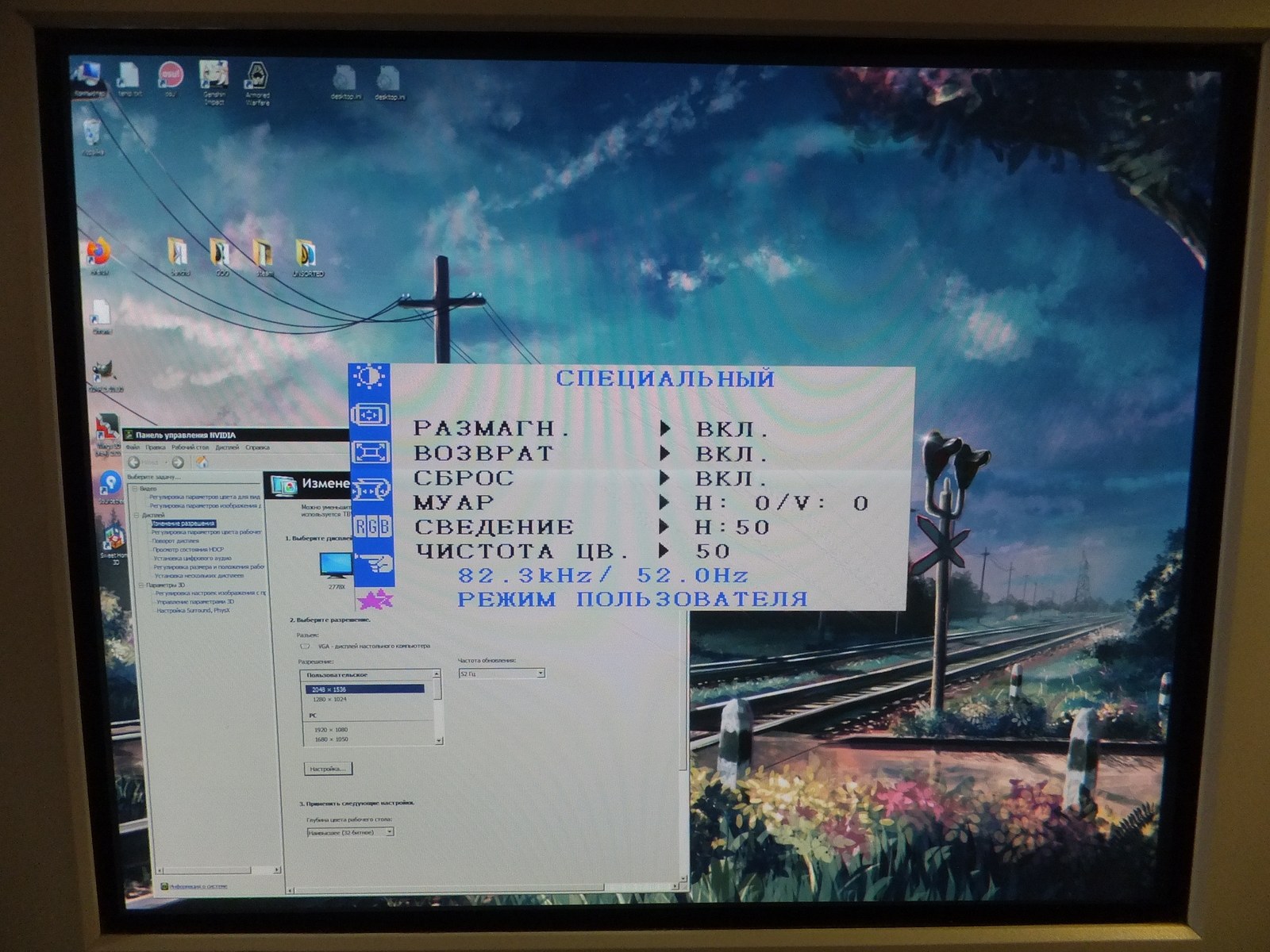

Именно в стандартных параметрах масштабирования оказался весь обман со стороны NVIDIA, при стандартных настройках драйвер NVIDIA всегда использует масштабирование, и когда пользователь создает разрешение 2048x1536 при 82 Гц, драйвер NVIDIA использует масштабирование чтобы 2048x1536 вместить в стандартное разрешение по EDID монитора 1024х768.

Именно по вине масштабирования NVIDIA случалось "съедание" изображения по краям и это невозможно было исправить настройками монитора.

Еще обращаю внимание, в разделе масштабирования на первом фото пишет 82 Гц, но на самом деле монитор работает в режиме 60 Гц, NVIDIA настолько усложняет простые вещи что драйвер сам не знает что делает судя по всему...

И отключить масштабирование при уже созданном пользовательском разрешении не выйдет, картинка все равно будет на вывод уходить при 1024x768 даже если масштабирование якобы отключено в настройках NVIDIA (второе фото получилось размыто, но суть полагаю ясна).

|

|

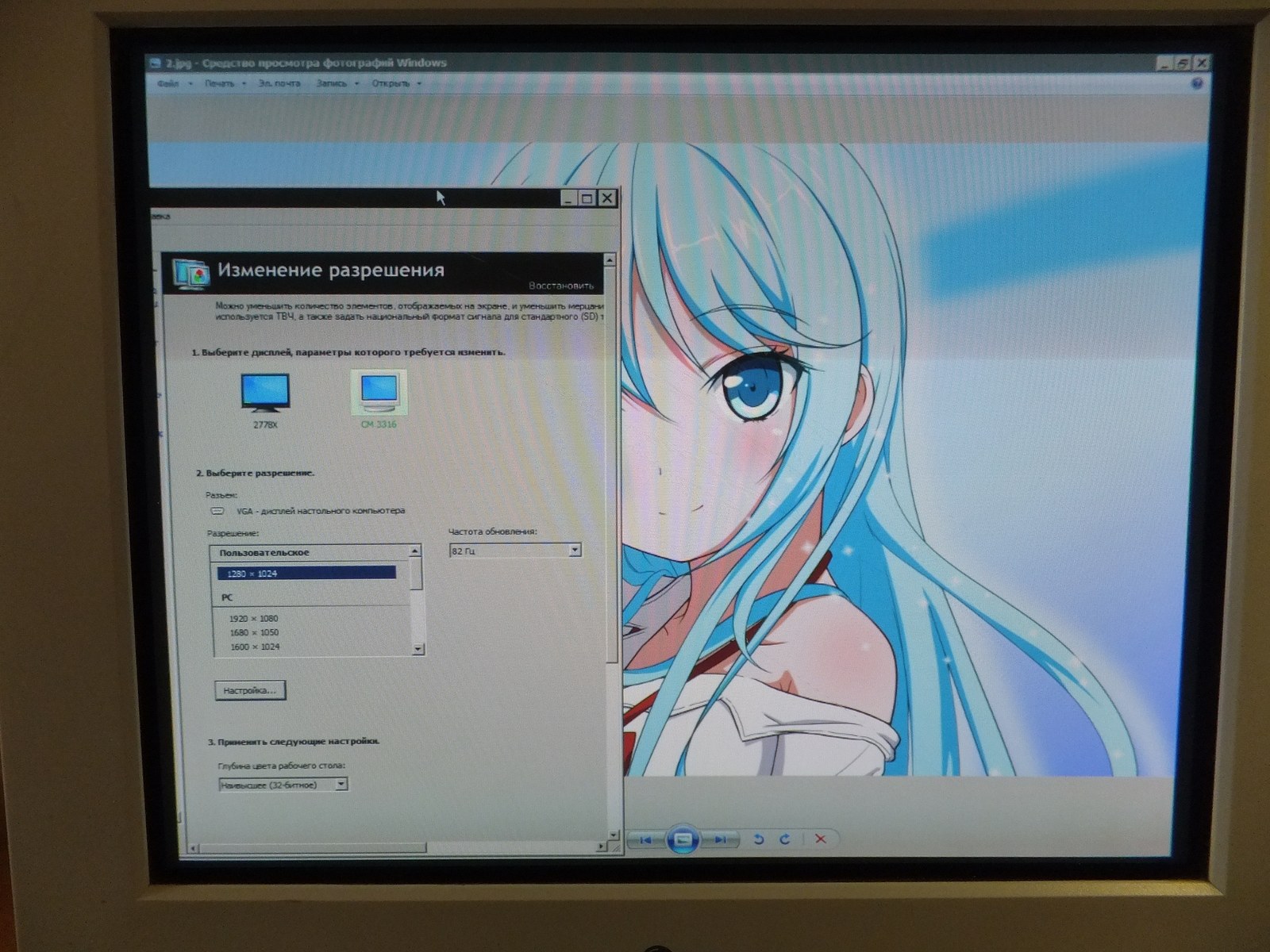

Правильная настройка монитора

Прежде всего следует посмотреть на поля которые NVIDIA по стандарту отводит от взгляда пользователя, и в данном случае драйвер NVIDIA в режиме "авто" задал заведомо нерабочие параметры для монитора, вот так "везение"...

Монитор сейчас работает при 1280x1024 из списка стандартных разрешений.

После установки пользовательского разрешения "1280x1024" драйвер NVIDIA уже выставил в серых полях вполне рабочий режим для монитора 1024x768, но я не смогу создать еще одно "1280x1024 82 Гц" разрешение так как драйвер запрещает.

|

|

Потому я пошел на хитрость и указал 81 Гц, но используя синхронизацию CVT с настоящими 1280x1024, а не масштабированными в 1024x768 как делает драйвер NVIDIA по стандарту.

Теперь можно сравнить качество изображения между "1280x1024" от NVIDIA и настоящими 1280x1024.

Выглядит неубедительно пока экран фотографирую целиком:

|

|

Но что если посмотреть внимательнее?

Разгон

Исходя из результатов разгона предыдущей статьи, я не стану разгонять HDMI-VGA переходник так как очевидно что он медленнее и не вытягивает высокие скорости, потому займусь разгоном DisplayPort-VGA переходника.

Исходя из спецификаций монитора я могу спокойно подавать до 98 кГц по горизонтали и 160 кГц по вертикали, пропускная способность канала до 203 МГц и разрешение 1600x1200 на 75 Гц.

Очевидно что настоящие 2048x1536 82 Гц выходят далеко за пределы возможностей монитора, и без "руки помощи" со стороны NVIDIA такой режим в принципе не может заработать с моим монитором.

Даже если установить 60 Гц это выходит за возможности монитора, и на практике оно не работает в таком режиме.

Начал с малого, но монитор не принимает ниже ~48 Гц:

|

|

С настоящим разрешением получился разгон на уровне 2048x1536 52 Гц, это явно далеко от того, что с подачки NVIDIA выставлялось обманом с помощью масштабирования...

Тут уже отлично видна разница между настоящими 2048x1536, и "2048x1536" от NVIDIA которые я в прошлой статье еще даже привел в таблицу как результат разгона...

|

|

Пропускная способность канала явно превышена, 228 МГц при заявленном для монитора 203 МГц, это уже можно назвать разгоном, при более высокой частоте уже переходник ловит отвал, пожалуй это и есть предел.

Но не обошлось и без неприятностей, к предыдущей статье как раз человек оставил комментарий про выключение изображения на секунду или две, именно это поведение и проявилось при максимальном режиме работы монитора в разрешении 2048x1536 52 Гц.

Так или иначе стоит еще раз посмотреть на качество изображения, и сравнить "2048x1536" с обманом от NVIDIA и настоящие 2048x1536:

|

|

Без комментариев...

|

|

Заключение

Для начала начну с технических характеристик, и в этот раз с учетом подставы от NVIDIA...

| Технические характеристики | ||

| - | Старый HDMI-VGA | Zihan DP-VGA |

| Чип | TSC9669S | CM3166E |

| Стоимость | ~2-3$ (предположительно) | ~3$ |

| Вход (подключение к видеокарте) | HDMI | DisplayPort |

| Выход (монитор) | VGA | |

| Максимальное разрешение | 1920x1080 (стандартное) 2048x1536 (ручная настройка) |

|

| Разгон ЭЛТ монитор LG Flatron F900B |

- | 2048x1536 - 52 Гц (~228 МГц) 1280x1024 - 90 Гц (~170 МГц) |

| Проблемы | 1) Сильный нагрев. | Нет |

Если бы я раньше никогда не использовал ЭЛТ мониторы, то и не придал бы особого значения заниженному качеству изображения, но я раньше использовал ЭЛТ монитор, правда это было с видеокартой от AMD в лице RX 560, я просто подключал монитор через переходник и использовал без проблем.

Но сейчас я использую GTX 1070, и драйвера NVIDIA, как всегда, подставляют пользователя настройками по умолчанию...

Причем все подставы со стороны NVIDIA носят скрытный характер, ограниченный RGB диапазон далеко не каждый человек сразу заметит и далеко не на каждом мониторе.

Влияние от конского размера очереди кадров тоже далеко не в любой игре можно заметить, я сейчас говорю про настройку "режим низкой задержки" которая в "свежих" версиях драйверов NVIDIA по умолчанию выставлена в "выкл" что подразумевает 2 кадра очереди или более.

Раньше настройка "режим низкой задержки" называлась "максимальное количество заранее подготовленных кадров" и по умолчанию раньше была выставлена в 0 (по умолчанию) позволяя приложению устанавливать желаемую очередь кадров.

А теперь я столкнулся с "масштабированием", невнимательный человек посмотрит на низкокачественное изображение ЭЛТ монитора по вине NVIDIA с её стандартными подкрутками масштабированием, и решит что это сам монитор такой ужасный, мол чего хотеть от монитора которому четверть века скоро будет...

Да и не стоит забывать про "съеденное" изображение которое невозможно настроить самим монитором, это тоже оказалась полностью вина драйвера NVIDIA.

Причем даже разрешения из стандартного списка порой работают через масштабирование если видеокарта от NVIDIA, это крайне неприятная ситуация...

Я в очередной раз убеждаюсь что с видеокартами от NVIDIA нужно крайне внимательно работать, ибо очень много подлостей со стороны драйвера уже повстречал.

Как то в интернете я наблюдал ситуацию когда говорили что якобы с AMD невозможно нормально создавать пользовательские разрешения, а с NVIDIA легко и просто все работает, теперь я понимаю почему оно "работает"...

На этом все, благодарю за внимание.

|

|

Лента материалов

Соблюдение Правил конференции строго обязательно!

Флуд, флейм и оффтоп преследуются по всей строгости закона!

Комментарии, содержащие оскорбления, нецензурные выражения (в т.ч. замаскированный мат), экстремистские высказывания, рекламу и спам, удаляются независимо от содержимого, а к их авторам могут применяться меры вплоть до запрета написания комментариев и, в случае написания комментария через социальные сети, жалобы в администрацию данной сети.