Micron анонсировала модуль LPDRAM SOCAMM2 емкостью 256 ГБ и назвала его первым решением такого объема в этом форм-факторе для дата-центров. Компания разработала новинку совместно с NVIDIA и рассчитывает закрыть растущий спрос на память в инфраструктуре, где ИИ-модели обрабатывают длинные контексты и большие объемы данных.

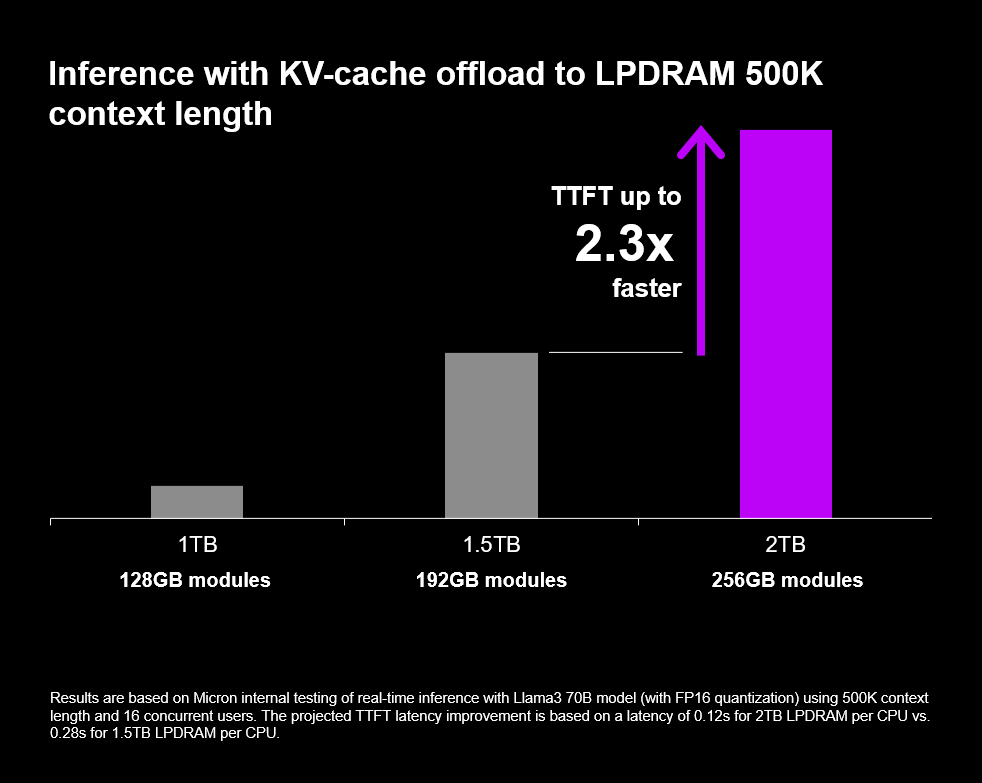

В новой версии компания увеличила объем монолитного кристалла LPDRAM до 32 ГБ. В конфигурации на 256 ГБ система обеспечивает до 2 ТБ LPDRAM на каждый восьмиканальный процессор. Такой объем упрощает обработку длинных контекстных окон, которые требуют современные ИИ-модели.

В Micron заявляют об улучшении времени первого токена в 2,3 раза для задач вывода с длинным контекстом. Для агентного ИИ, где важна автономная работа приложений, это ключевой параметр.

Новые модули потребляют меньше энергии по сравнению с традиционной серверной памятью. Иэн Файндер из NVIDIA отметил, что SOCAMM2 открывает возможности для создания процессоров ИИ следующего поколения.

Платформа NVIDIA Vera Rubin станет одной из первых, где применят новый стандарт памяти. Образцы SOCAMM2 уже отгрузили клиентам. Публичную презентацию проведут на конференции GTC 2026.

* все иллюстрации Micron