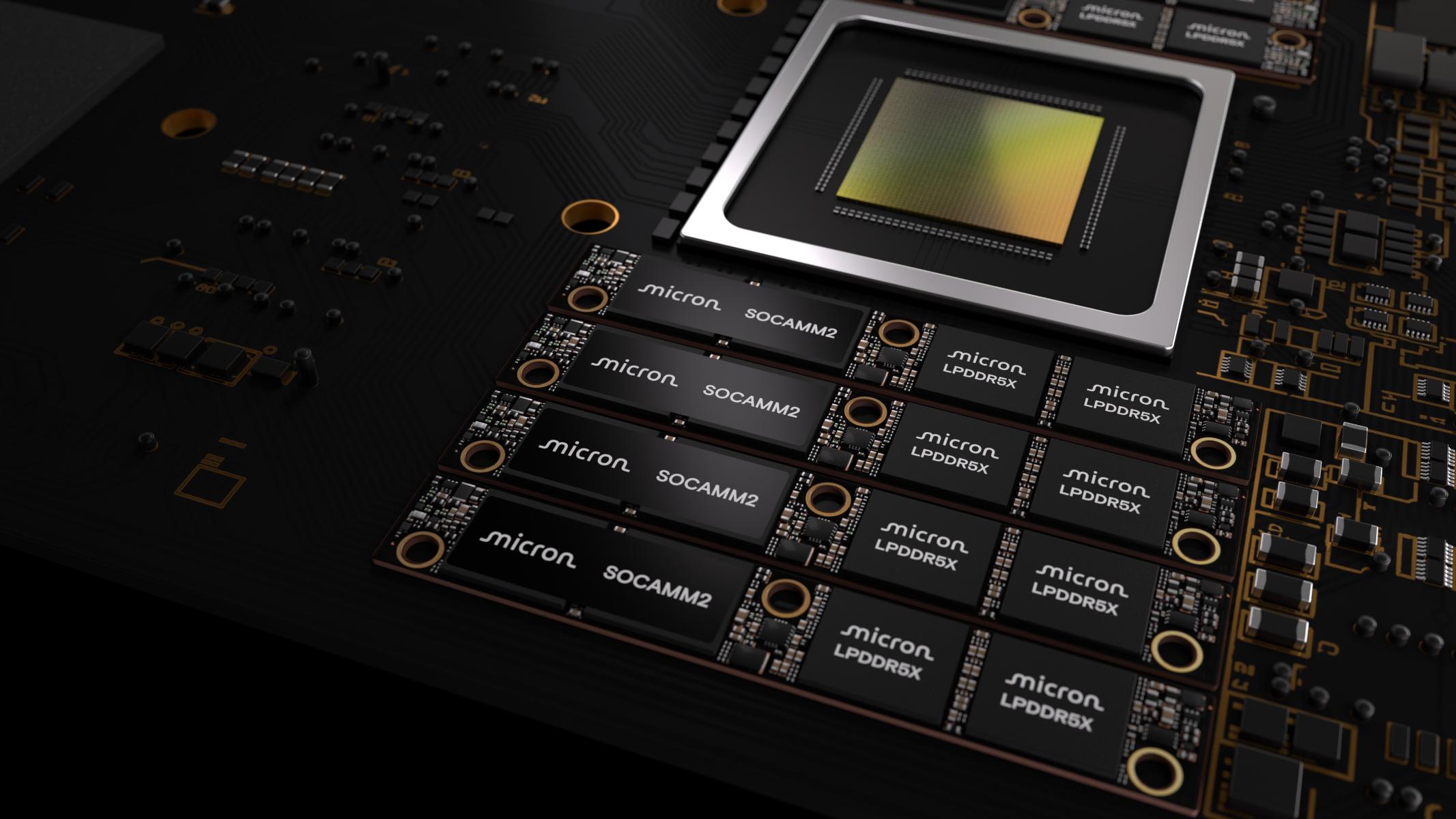

Компания Micron представила модуль оперативной памяти LPDRAM SOCAMM2 объёмом 256 ГБ, разработанный для центров обработки данных и серверных платформ искусственного интеллекта, сообщает VideoCardz.com. Компания заявляет, что новый модуль отвечает требованиям к объёму и пропускной способности для современных рабочих нагрузок, включая машинное обучение и аналитику в оперативной памяти.

Источник изображения: MicronМодуль основан на технологии DRAM с низким энергопотреблением, адаптированной для серверного использования, а компактный форм-фактор обеспечивает более высокую плотность памяти по сравнению с традиционными модулями RDIMM и LRDIMM. Это позволяет системным интеграторам увеличить общий объём памяти при сохранении более низкого энергопотребления.

Источник изображения: MicronМодуль основан на технологии DRAM с низким энергопотреблением, адаптированной для серверного использования, а компактный форм-фактор обеспечивает более высокую плотность памяти по сравнению с традиционными модулями RDIMM и LRDIMM. Это позволяет системным интеграторам увеличить общий объём памяти при сохранении более низкого энергопотребления.

Согласно внутренним тестам Micron, за счёт перехода на модули LPDRAM объёмом 256 ГБ производительность серверов общего назначения может вырасти до 4 раз при выполнении рабочих нагрузок Apache Spark SVM. Повышение производительности достигается за счёт большего объёма памяти и минимизации перемещения данных.

Компания Micron позиционирует LPDRAM SOCAMM2 объёмом 256 ГБ как решение для задач искусственного интеллекта, аналитики и облачных сред, где объем используемой памяти является ограничивающим фактором. Информация о доступности и поддерживаемых платформах пока не разглашается.